In collaborazione con Nvidia, Google Cloud si sta adoprando per portare le GPU nel mondo del big data processing, per sbloccare nuove possibilità per i clienti della piattaforma di Big G.

Con Dataflow GPU, gli utenti possono ora sfruttare la potenza delle GPU Nvidia nelle loro pipeline di dati. Questa opzione riunisce la semplicità e la ricchezza di Apache Beam, i vantaggi serverless e no-ops di Dataflow e la potenza del GPU Computing.

Le Dataflow GPU, ha annunciato Google Cloud, vengono fornite on-demand e si paga solo per la durata del job.

Le aziende di tutte le dimensioni e di tutti i settori, ha messo in evidenza Google Cloud, stanno passando attraverso trasformazioni data driven.

Un elemento chiave di questa trasformazione è l’uso dell’elaborazione dei dati insieme al machine learning per analizzare e prendere decisioni sui sistemi, gli utenti, i dispositivi e il più ampio ecosistema in cui operano.

Dataflow consente di elaborare grandi quantità di dati – compresi i dati strutturati, i dati di log e dei sensori, i file audio e video e altri dati non strutturati – e di utilizzare il machine learning per prendere decisioni che hanno un impatto sul business e sugli utenti.

Per esempio, i clienti di Google Cloud, ha sottolineato la società, stanno utilizzando Dataflow per risolvere problemi come il rilevamento delle frodi con carte di credito, il rilevamento di intrusioni fisiche analizzando lo streaming video e il rilevamento di intrusioni di rete mediante l’analisi dei log del network.

A differenza delle CPU, che sono ottimizzate per il calcolo generico, le GPU sono ottimizzate per l’elaborazione in parallelo. Le GPU implementano un’architettura SIMD (single instruction, multiple data), che le rende più efficienti per gli algoritmi che elaborano grandi blocchi di dati in parallelo. Le applicazioni che devono elaborare media e applicare il machine learning, ha spiegato Google Cloud, in genere traggono vantaggio dalla natura altamente parallela delle GPU.

I clienti di Google Cloud possono ora utilizzare le GPU Nvidia per accelerare i task di big data processing oltre all’elaborazione delle immagini e alle attività di machine learning quali le previsioni.

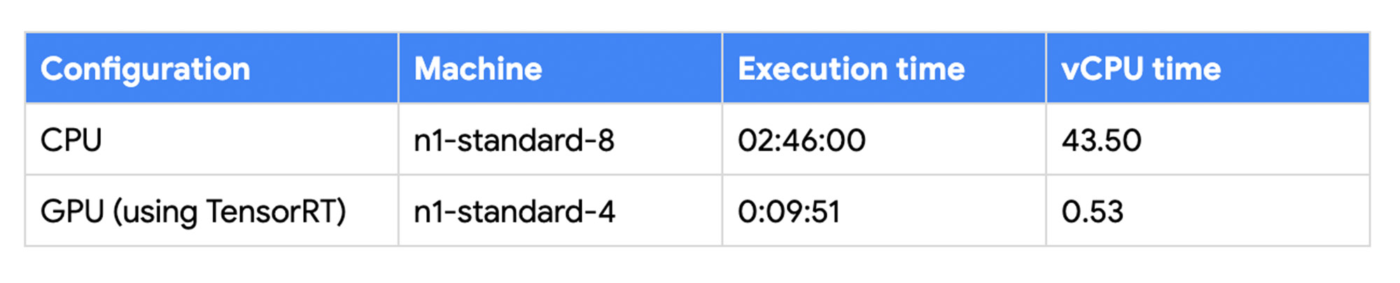

Per comprendere i potenziali vantaggi, Nvidia ha eseguito dei test per confrontare le prestazioni della pipeline Dataflow che utilizza un modello di machine learning TensorRT ottimizzato BERT (Bidirectional Encoder Representations from Transformers) per l’elaborazione del linguaggio naturale.

L’uso di Dataflow GPU per accelerare la pipeline ha portato a una riduzione di un ordine di grandezza nell’uso della CPU e della memoria per la pipeline.

Ed è per questo che ora Google Cloud consiglia ai propri clienti di testare Dataflow GPU con i propri carichi di lavoro, poiché l’entità del vantaggio dipende dai dati e dal tipo di calcolo che viene eseguito.

Con Dataflow GPU, i clienti hanno la scelta e la flessibilità di poter utilizzare una qualsiasi delle seguenti GPU Nvidia ad alte prestazioni: T4 Tensor Core, Tesla P4, V100 Tensor Core, Tesla P100, Tesla K80.

I notebook Apache Beam consentono agli utenti di sviluppare iterativamente le pipeline, e ispezionare il grafico della pipeline in modo interattivo utilizzando i notebook JupyterLab. Google ha aggiunto il supporto per la GPU ai notebook Apache Beam: ciò permette di sviluppare facilmente un nuovo job Apache Beam che sfrutti la GPU e di testarlo in modo iterativo prima del deployment in Dataflow.

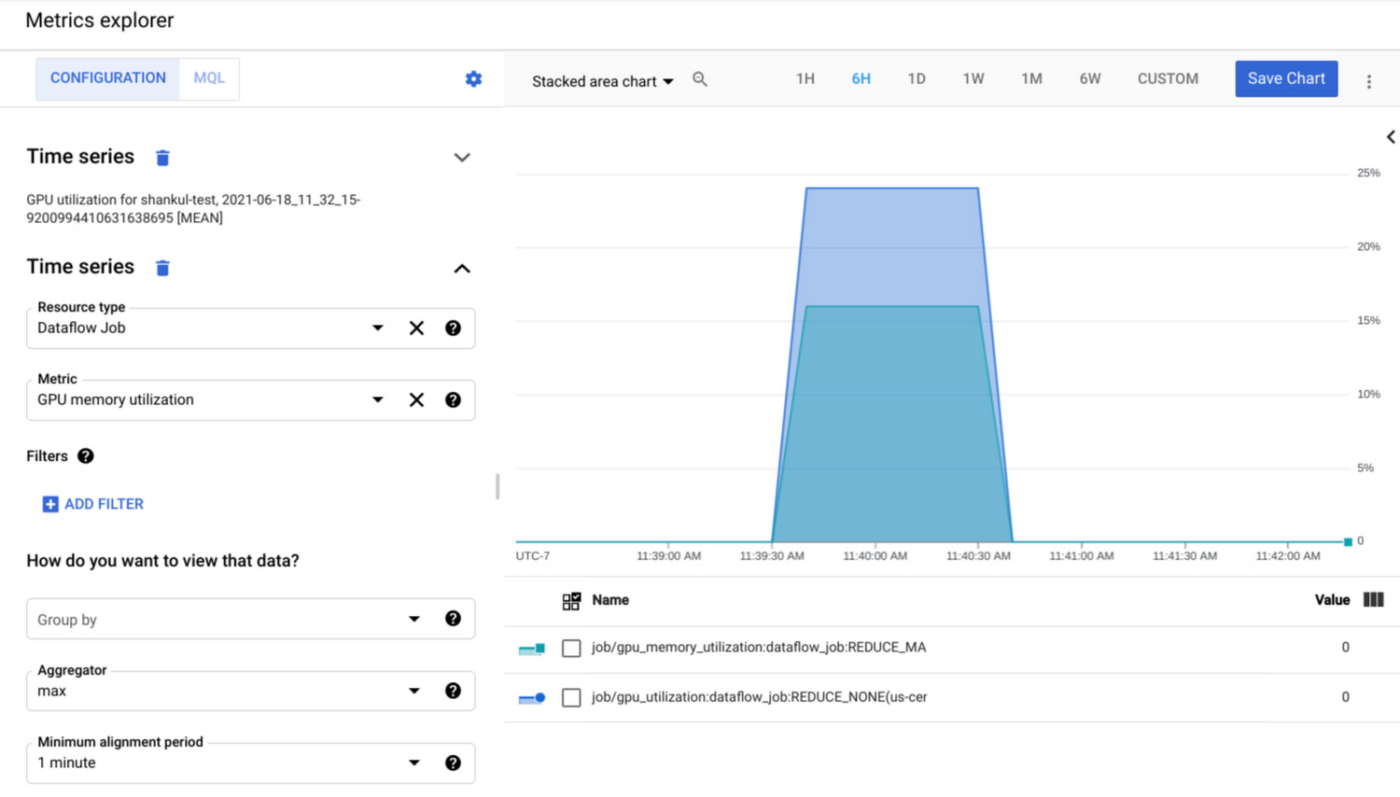

Inoltre, Google Cloud ha integrato il monitoraggio della GPU in Cloud Monitoring. Di conseguenza, gli utenti possono monitorare le prestazioni e l’uso delle risorse GPU nella propria pipeline e ottimizzare di conseguenza, in modo facile.