Non è stato solo il drone Prime Air l’unico protagonista della conferenza re: MARS 2019: lo sono state anche la moda e lo shopping di abbigliamento, sempre però all’insegna dell’intelligenza artificiale, con Amazon StyleSnap.

Quest’ultima innovazione di Amazon Fashion si prefigge un obiettivo ambizioso: cambiare per sempre il modo in cui i clienti fanno shopping.

Amazon StyleSnap è una nuova funzionalità basata sull’intelligenza artificiale che aiuta i clienti a fare acquisti. Immaginiamo di aver visto un look che ci piace, in una foto su un social oppure di una celebrità: tradurlo in parametri di ricerca non è una cosa semplice.

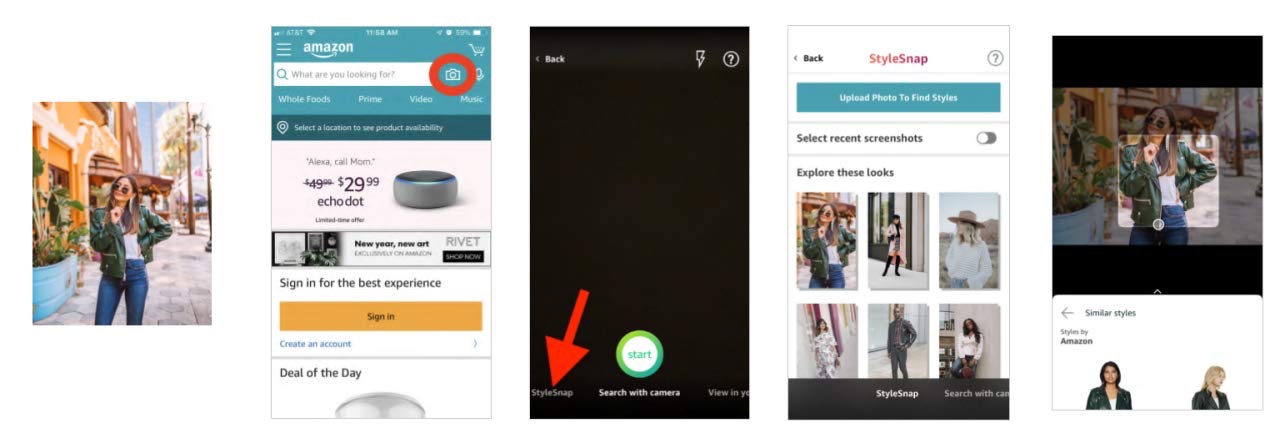

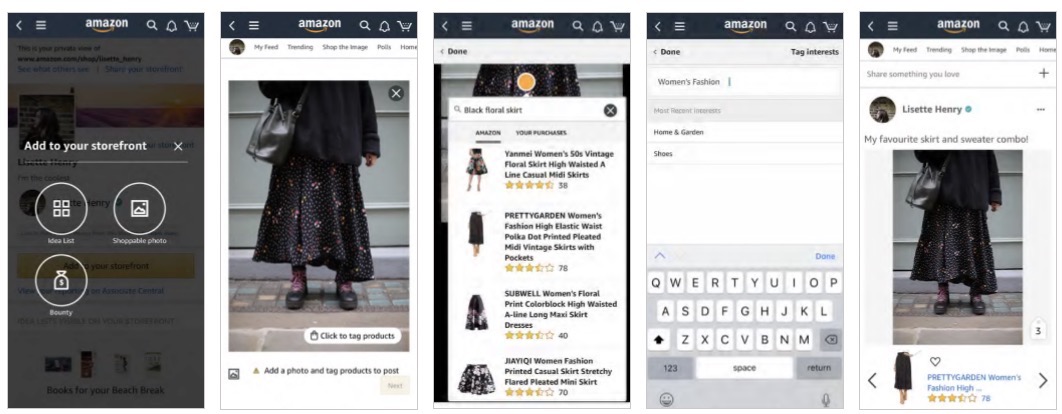

Con Amazon StyleSnap, invece, tutto ciò che bisogna fare è scattare una foto o fare uno screenshot del look che ci piace. Tuttavia, questa semplicità apparente della customer experience nasconde la complessità della tecnologia che sta dietro, come ha sottolineato Jeff Wilke, CEO Consumer Worldwide di Amazon.

Con Amazon StyleSnap, invece, tutto ciò che bisogna fare è scattare una foto o fare uno screenshot del look che ci piace. Tuttavia, questa semplicità apparente della customer experience nasconde la complessità della tecnologia che sta dietro, come ha sottolineato Jeff Wilke, CEO Consumer Worldwide di Amazon.

Come funziona Amazon StyleSnap

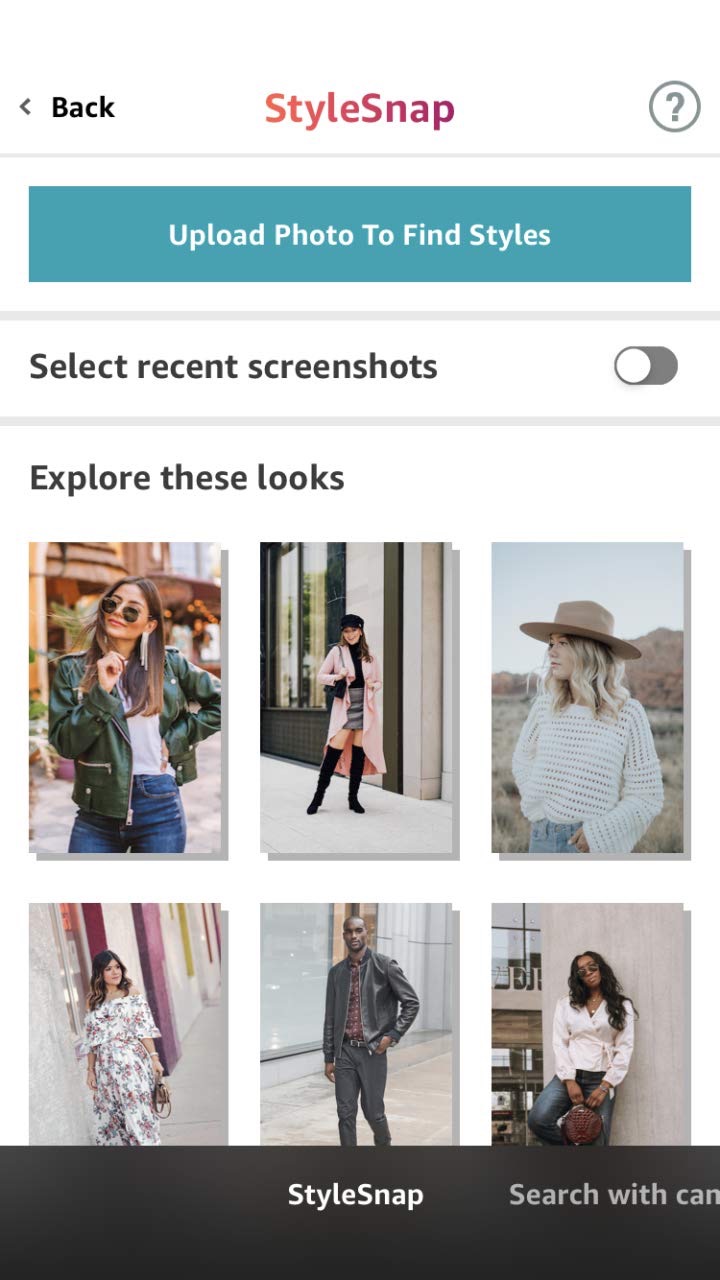

Per iniziare a sfruttare la funzione, tutto ciò che occorre fare è cliccare sull’icona della fotocamera nell’angolo in alto a destra dell’App Amazon e selezionare l’opzione StyleSnap. A quel punto, basta semplicemente caricare una foto o uno screenshot di un look alla moda che ci piace. StyleSnap ci presenterà suggerimenti su oggetti simili presenti su Amazon che corrispondono al look della foto. Quando fornisce i consigli, StyleSnap considera una varietà di fattori, come la marca, la fascia di prezzo e le recensioni dei clienti.

StyleSnap presenta una customer experience semplice e fluida per i clienti, ma l’implementazione di questa funzione, racconta Amazon, è stata tutt’altro che facile. Le immagini lifestyle e i post degli influencer sono imprevedibili, con pose e location tra le più svariate.

Dietro le quinte, StyleSnap utilizza la computer vision e il deep learning per identificare gli articoli di abbigliamento in una foto, indipendentemente dal setting. La tecnologia di deep learning aiuta anche a classificare gli articoli di abbigliamento individuati nell’immagine in categorie.

Dietro le quinte, StyleSnap utilizza la computer vision e il deep learning per identificare gli articoli di abbigliamento in una foto, indipendentemente dal setting. La tecnologia di deep learning aiuta anche a classificare gli articoli di abbigliamento individuati nell’immagine in categorie.

Per far sì che le reti neurali identifichino un numero maggiore di classi (ad esempio di stili diversi di gonne), è possibile sovrapporre un numero maggiore di livelli, uno sopra l’altro. Nei primi livelli il sistema apprende, in genere, concetti quali i bordi e i colori, mentre i livelli intermedi identificano pattern quali “floreale” o “denim”. Dopo aver attraversato tutti i livelli, l’algoritmo può identificare con precisione concetti quali vestibilità e stile di abbigliamento in un’immagine.

Tuttavia le reti neurali feed-forward, dopo dopo l’aggiunta di un certo numero di layer, si bloccheranno e alla fine si degraderanno. Questo fenomeno è noto come il problema della scomparsa del gradiente, in cui il segnale dai dati di training è talmente sparso tra i layer da essere completamente perso, in reti neurali profonde.

Per risolvere questo problema, Amazon utilizza reti neurali residuali, che lo prevengono utilizzando delle “scorciatoie” per consentire al segnale di training di saltare alcuni dei layer nella rete. Ciò aiuta la rete ad apprendere prima le funzionalità di base, come “bordi” e “schemi”, per poi focalizzarsi su concetti complessi. Un metodo unico, sviluppato dai ricercatori di Amazon, consente alla rete di apprendere nuovi concetti, ricordando al tempo stesso anche le cose che ha appreso in passato: ciò è fondamentale per consentire a StyleSnap di funzionare in modo efficace su grandi volumi di dati.

Se, da un lato, Amazon StyleSnap consente ai clienti di scoprire articoli di moda semplicemente dagli screenshot di look che li ispirano, la funzione aiuta anche gli influencer della moda a espandere le loro comunità. I fashion influencer che partecipano all’Amazon Influencer Program potranno anche ricevere commissioni per gli acquisti che ispirano.

Se, da un lato, Amazon StyleSnap consente ai clienti di scoprire articoli di moda semplicemente dagli screenshot di look che li ispirano, la funzione aiuta anche gli influencer della moda a espandere le loro comunità. I fashion influencer che partecipano all’Amazon Influencer Program potranno anche ricevere commissioni per gli acquisti che ispirano.