In occasione della conferenza GTC 21 (GPU Technology Conference), Nvidia ha svelato numerose novità in ambito cloud e edge computing, intelligenza artificiale, 5G, applicazioni enterprise e high performance computing.

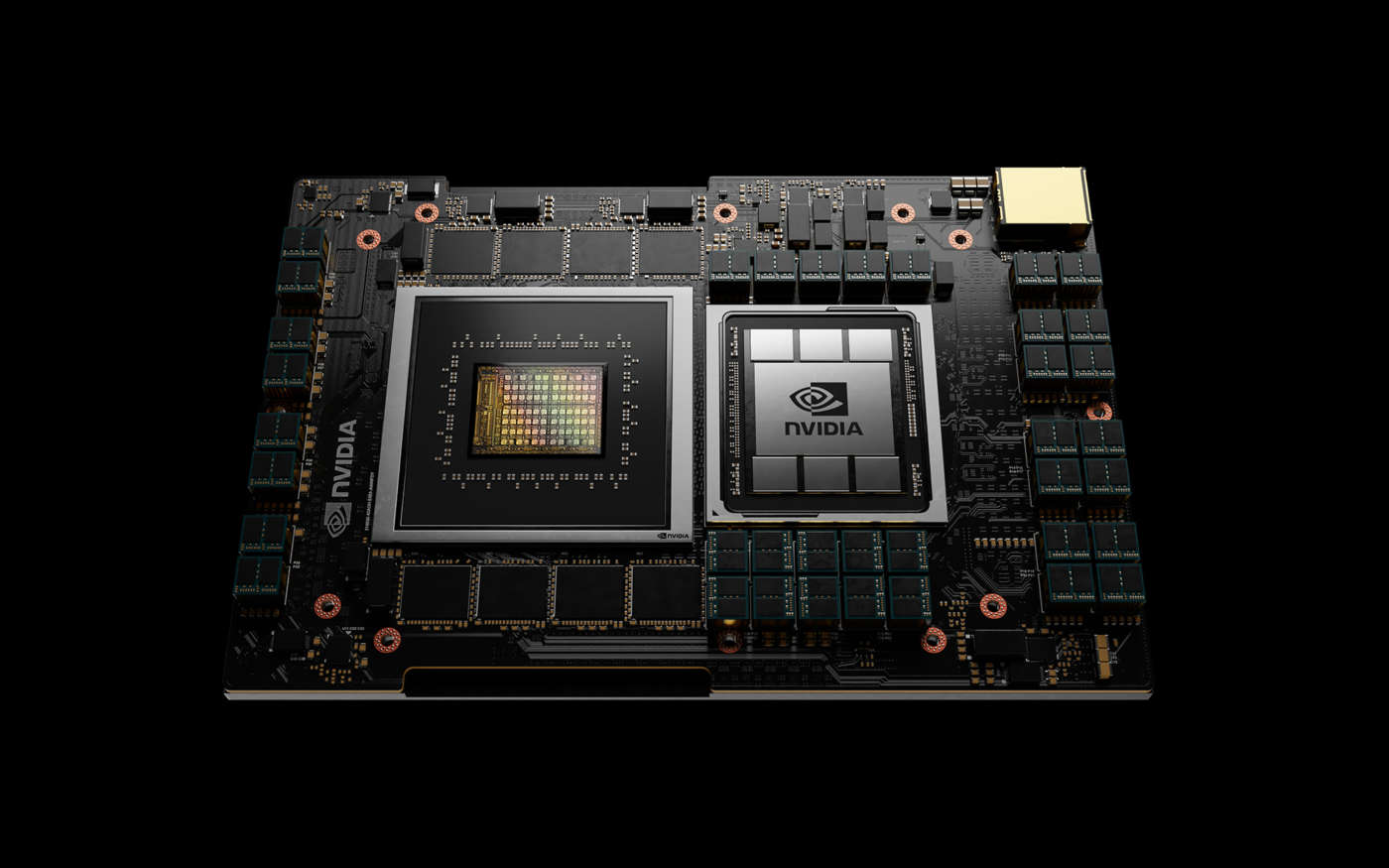

Nvidia Grace è la prima CPU per data center della società. Si tratta di un processore basato su architettura Arm che, ha sottolineato l’azienda, fornirà prestazioni 10 volte superiori a quelle dei server più veloci di oggi sui più complessi carichi di lavoro di intelligenza artificiale e high performance computing.

La nuova CPU Nvidia Grace è progettata per rispondere ai requisiti di computing delle applicazioni più avanzate, tra cui il natural language processing, i sistemi di raccomandazione e l’AI supercomputing, che analizzano enormi serie di dati che richiedono sia prestazioni di calcolo che di memoria ultra-veloci. Il processore combina core Arm CPU con un innovativo sottosistema di memoria a basso consumo per fornire prestazioni elevate con, al contempo, una elevata efficienza energetica.

Rimanendo in tema, Nvidia BlueField-3 è la nuova data processing unit di nuova generazione, progettata per offrire le più elevate funzionalità di accelerazione di networking, storage e cybersecurity software-defined per i data center.

Questa DPU costruita per l’intelligenza artificiale e il calcolo accelerato permette alle imprese di fornire applicazioni su qualsiasi scala con prestazioni elevate e sicurezza. È ottimizzata per ambienti multi-tenant e cloud-native, per offrire servizi di rete, storage, sicurezza e management definiti dal software e accelerati dall’hardware.

Una DPU BlueField-3, ha dichiarato Nvidia, può fornire i servizi di data center equivalenti a 300 core di CPU, permettendo così di liberare preziosi cicli di CPU per eseguire applicazioni business-critical.

Il Ceo di Nvidia Jensen Huang ha anche delineato la roadmap dell’azienda per i suoi prodotti di silicio. Grace e BlueField sono parti fondamentali di una roadmap focalizzata sui data center costituita da tre chip: CPU, GPU e DPU, ha dichiarato Huang. Ogni architettura di chip ha un ritmo di due anni, un anno focalizzato sulle piattaforme x86 e quello successivo su Arm.

Riguardo alla seconda piattaforma, Nvidia ha poi annunciato una serie di collaborazioni che combinano GPU e software NVIDIA con CPU Arm, finalizzate a estendere i vantaggi dell’architettura flessibile ed efficiente dal punto di vista energetico di Arm ai carichi di lavoro di computing dal cloud all’edge.

Tra le iniziative: istanze Amazon EC2 basate su AWS Graviton2 con GPU Nvidia; il supporto allo sviluppo di applicazioni scientifiche e di intelligenza artificiale con un nuovo HPC Developer Kit; il potenziamento dei video analytics e delle funzionalità di sicurezza sull’edge e la creazione di una nuova classe di Pc basati su Arm con GPU Nvidia RTX.

Oltre a quella con Amazon Web Services nel cloud, delle partnership annunciate da Nvidia fanno parte quelle con Ampere Computing nel calcolo scientifico e nel cloud computing, Marvel nei server edge iperconvergenti e MediaTek per creare un SDK e un sistema di riferimento per Pc Chrome OS e Linux.

Ancora: Nvidia ha svelato il nuovo supercomputer di intelligenza artificiale cloud-native e multi-tenant, la nuova generazione di DGX SuperPOD con DPU BlueField-2. Questo upgrade potenzia il DGX SuperPOD con le DPU BlueField-2, data processing unit che accelerano e forniscono connessioni sicure alla infrastruttura di intelligenza artificiale delle aziende.

La società ha anche annunciato Nvidia Base Command, che permette a più utenti e team It di accedere, condividere e gestire in modo sicuro l’infrastruttura DGX SuperPOD. Base Command coordina il training e le operazioni di intelligenza artificiale sull’infrastruttura DGX SuperPOD per consentire il lavoro in team di data scientist e sviluppatori dislocati in tutto il mondo.

Per “democratizzare” ulteriormente l’intelligenza artificiale, Nvidia ha poi introdotto una nuova classe di sistemi certificati dall’azienda, che include server enterprise ad alto volume dei principali produttori che sono ora certificati per eseguire la suite software Nvidia AI Enterprise, certificata per VMware vSphere 7.

A espandere l’ecosistema di server certificati Nvidia è in arrivo una nuova ondata di sistemi con GPU Nvidia A30 per l’intelligenza artificiale mainstream e l’analisi dei dati e GPU A10 per la grafica abilitata dall’IA, le workstation virtuali e i carichi di lavoro misti di computing e grafica.

Per quanto riguarda la connettività veloce di ultima generazione per i network edge, l’azienda ha annunciato una partnership con Fujitsu, Google Cloud, Mavenir, Radisys e Wind River per sviluppare soluzioni per la piattaforma AI-on-5G di Nvidia, per accelerare la creazione di città e fabbriche smart, ospedali avanzati e negozi intelligenti.

Le imprese, gli operatori di rete mobile e i fornitori di servizi cloud che implementano la piattaforma saranno in grado di gestire sia il 5G che l’edge AI computing in una singola piattaforma convergente.