Non ci sono solo novità di prodotto, alla I/O Developers Conference di Google: come è lecito attendersi da un evento rivolto agli sviluppatori, Sundar Pichai, Ceo di Google e Alphabet, e i suoi collaboratori hanno tracciato anche quelle che sono le direzioni verso cui sta andando la società di Mountain View.

E non solo Google, perché tecnologie come l’intelligenza artificiale e il quantum computing sono diffusamente considerate come le nuove frontiere dell’informatica, e in parte già stanno cambiando le nostre vite.

I notevoli progressi fatti nei circa 22 anni di operatività di Google hanno le loro fondamenta proprio nei passi avanti compiuti in alcune delle aree più difficili dell’intelligenza artificiale, tra cui la traduzione, le immagini e la voce.

Questi progressi, ha sottolineato il Ceo dell’azienda, hanno alimentato miglioramenti in tutti i prodotti Google, abilitando molteplici funzionalità avanzate in Assistant, su Foto, quando si utilizza Google Lens e in tanti altri servizi e app.

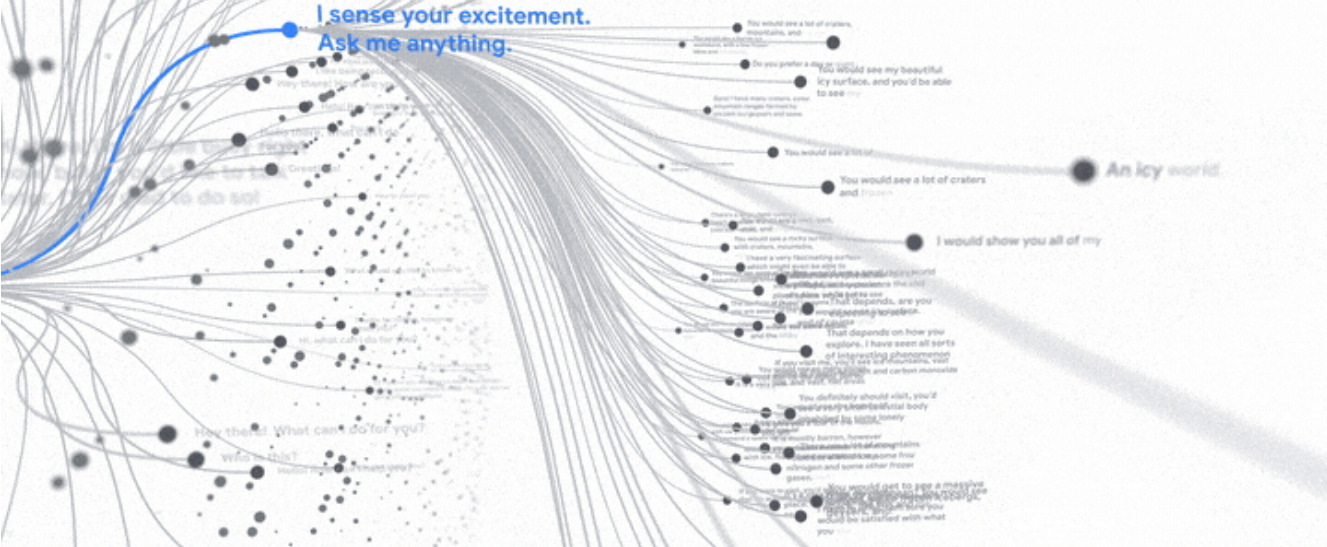

In occasione di Google I/O, Sundar Pichai ha condiviso l’ultima ricerca di Google nel campo della comprensione del linguaggio naturale: LaMDA.

LaMDA, ha spiegato Google, è un modello linguistico per applicazioni conversazionali. È open domain, il che significa che è progettato per conversare su qualsiasi argomento. Nel keynote, Google ha mostrato un esperimento in cui LaMDA interpretava il pianeta Plutone rispondendo a diverse domande con discorsi molto naturali.

Secondo Google, LaMDA ha la potenzialità per rendere l’informazione e il computing radicalmente più accessibili e facili da usare.

Questo è il frutto di molti anni di ricerca e sviluppato sui modelli linguistici da parte di Google, che intende anche prestare attenzione per garantire che LaMDA soddisfi standard molto alti di correttezza, accuratezza, sicurezza e privacy, e che sia sviluppato coerentemente con i principi di intelligenza artificiale dell’azienda.

Al momento è una tecnologia sperimentata internamente, ma l’intento è quello di incorporare le funzioni di conversazione di nuova generazione in prodotti come Google Assistant, Search e Workspace, oltre a offrire tali funzionalità agli sviluppatori e ai clienti enterprise.

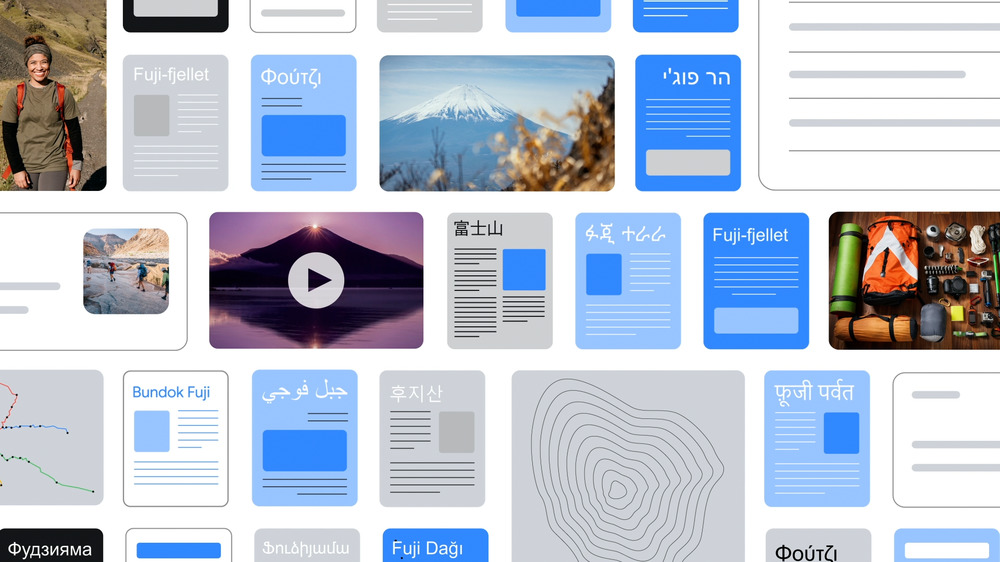

LaMDA è un enorme passo avanti nella conversazione naturale, ha sottolineato Google, ma è ancora addestrato solo sul testo. Quando le persone comunicano tra loro lo fanno attraverso immagini, testo, audio e video.

Quindi c’è bisogno di costruire modelli multimodali (MUM, multimodal models) per permettere alle persone di fare domande in modo naturale attraverso diversi tipi di informazioni. Con MUM, secondo la società di Mountain View, si potrebbe un giorno pianificare un viaggio su strada chiedendo a Google semplicemente di “trovare un percorso con una bella vista sulle montagne“. Questo è un esempio fatto dalla stessa Google per illustrare i progressi che Big G sta facendo verso modi più naturali e intuitivi di interagire con la ricerca, che è tuttora il nucleo centrale delle attività di Google.

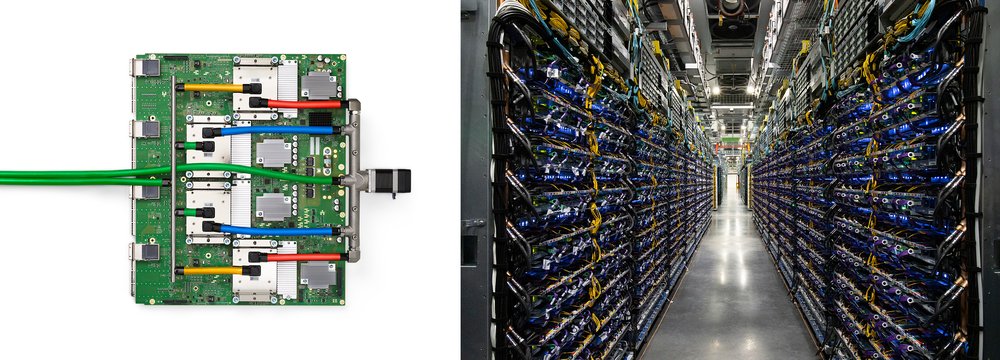

La traduzione, il riconoscimento delle immagini e il riconoscimento vocale hanno gettato le basi per modelli complessi come LaMDA e MUM. L’infrastruttura di calcolo è poi il modo in cui Google guida e sostiene questi progressi. Le TPU, unità custom-built di machine learning, rappresentano una grande parte di questo sforzo.

In occasione di Google I/O l’azienda ha annunciato la prossima generazione di TPU: le TPU v4. Queste sono potenziate dal chip v4, che è più il doppio più veloce della generazione precedente. Un pod può fornire più di un exaflop, equivalente alla potenza di calcolo di 10 milioni di computer portatili messi insieme.

Si tratta del sistema più veloce di cui Google abbia mai fatto il deploy, e una pietra miliare storica per l’azienda. In precedenza, per arrivare a un exaflop era necessario costruire un supercomputer personalizzato. Presto decine di pod TPUv4 popoleranno i data center di Google: saranno disponibili per i clienti Cloud entro la fine di quest’anno.

Guardando al futuro, ha però sottolineato Google, ci sono tipi di problemi che il computing classico non sarà in grado di risolvere in tempi ragionevoli. Il quantum computing può aiutare.

Per Google, raggiungere il quantum milestone è considerato già un risultato straordinario, ma l’azienda ha affermato di essere ancora all’inizio di un viaggio pluriennale. Big G continua a lavorare per arrivare alla sua prossima milestone nel quantum computing: costruire un computer quantistico error-corrected, che potrebbe aiutare ad aumentare l’efficienza delle batterie, creare energia più sostenibile e migliorare la scoperta di farmaci, tra le altre cose.

Per riuscire ad arrivarci, Google ha aperto il nuovo campus di Quantum AI all’avanguardia, con il primo data center quantistico con strutture per la fabbricazione di chip per processori quantistici di Google.