Sotto la guida del professor Antonio Cisternino, Delegato del rettore per l’informatica, i sistemi informativi dell’Università di Pisa sono al centro della trasformazione dell’ateneo, con un ripensamento delle infrastrutture per la ricerca e dei sistemi amministrativi per circa 3.000 utenti, tra docenti e personale interno, e per oltre 50.000 studenti.

Dalla fine degli anni novanta le strutture dell’Università sono collegate da una rete proprietaria in fibra ottica. Su questa infrastruttura di rete sono stati costruiti una serie di data center minori, con frammentazione del patrimonio informativo dell’Università. Inoltre, il 90% dei sistemi IT dell’Università di Pisa erano basati su open source.

La gestione del patrimonio informativo dell’Università rischiava di diventare troppo complessa e onerosa, tenendo conto della difficoltà di governare la manutenzione dei sistemi open source.

Maurizio Davini è Chief Technology Officer dell’Università di Pisa e il suo team è si occupa di progettazione, esecuzione e manutenzione delle reti e dei servizi IT.

Tre strutture parallele

Dovevamo consolidare e mettere in sicurezza diversi centri elaborazione dati, distribuiti nelle sedi dei dipartimenti: molti erano basati su tecnologie open source, dice Davini in una nota. La scelta è stata quindi di creare tre silos informativi e tecnologici paralleli, in modo da garantire la massima flessibilità.

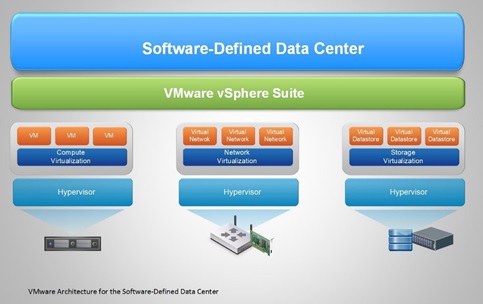

Alle tecnologie open source sono affidati i sistemi dedicati alla ricerca e sviluppo. Per gli applicativi più critici la scelta è stata di muoversi verso architetture di classe enterprise, che prevedessero contratti di manutenzione, puntando su infrastrutture di virtualizzazione basate anche su tecnologia VMware. I sistemi di messaggistica e collaborazione, infine, prevedono l’utilizzo di applicazioni Microsoft.

“Il nuovo disegno dell’IT d’ateneo parte da una scelta fondamentale, quella per la modernizzazione dei data center. È una scelta che ha visto nella virtualizzazione dei sistemi un tassello fondamentale e che si è basata, per tutti i sistemi server e database più critici, anche su tecnologia Vmware”, ha detto Davini.

La PA ha l’obbligo di approvvigionarsi, per quello che riguarda le infrastrutture informatiche, attraverso le convenzioni Consip. La conferenza dei rettori, che funge da collettore delle diverse esigenze dipartimentali, ha reso disponibile una convenzione a cui l’Università aderisce e che dà accesso a un gran numero di tecnologie avanzate.

In questo quadro l’Università ha acquistato un certo numero di server Dell in convenzione, utilizzandoli per costruire le nuove infrastrutture. La componente di integrazione è stata demandata al partner di VMware Assyrus, che ha lavorato in collaborazione con il personale interno, completando il progetto in meno di un mese.

Il nuovo data center ha permesso di avviare un rilevante consolidamento dei diversi centri di elaborazione dati che l’Università aveva distribuito nelle diverse sedi, passando a un un’infrastruttura che a regime avrà quattro data center ben identificati, tre di produzione enterpise e uno dedicato alle attività di ricerca e sviluppo. Uno dei nodi è un nuovo data center, collocato fuori città, a dieci chilometri di distanza, in una struttura di proprietà dell’Università.

Da questo modello infrastrutturale il team che gestisce i sistemi promuove la riprogettazione di una serie di servizi, sia dal punto di vista infrastrutturale, con nuove architetture di virtualizzazione e nuovi sistemi di supporto al calcolo per la ricerca, sia dal punto di vista applicativo, per quanto riguarda i software che sono a servizio dei processi amministrativi e tecnici dell’ateneo.

La virtualizzazione è una rivoluzione anche per il personale tecnico, che ha l’opportunità di conoscere strumenti molto innovativi. “I nostri sistemisti si stanno formando sulle nuove tecnologie: è un passaggio anche per loro e lo stanno vivendo con entusiasmo, anche perché hanno in mano degli strumenti molto più performanti e semplici da gestire”, spiega Davini.

“Con VMware abbiamo costruito un cluster di dodici server, diviso su più siti, e un’infrastruttura di virtualizzazione dello storage basata su vSAN – spiega Davini -. Abbiamo puntato su sistemi iperconvergenti, e questa architettura ci permette di aumentare in misura rilevante l’affidabilità e la disponibilità dei sistemi, sia dal punto di vista della potenza di calcolo, sia per quanto riguarda la disponibilità di storage. E soprattutto possiamo sfruttare al meglio le risorse disponibili, con la massima flessibilità. Tutto questo significa servizi migliori per gli utenti e una riduzione dei costi di gestione per noi”.

La nuova architettura è ormai quasi del tutto operativa, anche se alcune configurazioni devono ancora essere ottimizzate e nuovi servizi attendono di essere completati.