Siamo senza alcun dubbio entrati nell’era dei Big Data [1]. Accanto a teoria, sperimentazione e simulazione, i tre pilastri fondamentali della scoperta scientifica, l’analisi dei dati mediante supercalcolatori è di fatto oggi la più promettente via per estendere rapidamente le frontiere della conoscenza.

Un mondo di dati da analizzare

La mole di dati a nostra disposizione è immensa ed in continua espansione. Nel solo 2016 il traffico di dati trasmessi in internet supererà per la prima volta lo zettabyte (1021 bytes) [2], ovvero un miliardo di terabyte (1012 bytes, la dimensione tipica di un disco rigido moderno).

Cristiano Malossi, laureato in Ingegneria aerospaziale al Politecnico di Milano, si è occupato di geologia computazionale per Eni. In Svizzera ha ottenuto il PhD in Matematica Applicata presso l’Istituto Tecnologico Federale di Losanna, con una tesi sullo sviluppo di algoritmi e metodi matematici per la simulazione numerica nei problemi vascolari. Dal 2013 lavora con Ibm Research a Zurigo nel gruppo Foundations of Cognitive solutions.

Questo valore rappresenta solo una minuscola parte del volume di dati esistenti, basti pensare che ogni dispositivo elettronico, dai più comuni smartphone, fino ai più complessi macchinari industriali, è dotato di decine, centinaia, o più sensori, i quali raccolgono dati di ogni tipo, senza sosta. Per fare un esempio, il data center collegato all’acceleratore di particelle del CERN di Ginevra processa oltre un petabyte (1015 byte) di nuovi dati ogni giorno [3], i quali vengono successivamente riassunti, compressi, e solo in piccola parte conservati.

Un computer progettato per i dati

Questi esempi dimostrano quanto sia importante essere in grado di analizzare rapidamente i dati ed estrarne efficacemente le informazioni chiave. Tuttavia, per fare ciò non basta affidarsi ai più grandi supercalcolatori. Servono soluzioni innovative, appositamente progettate ed adattabili ai diversi tipi di dati (immagini, tabelle, testi, formule, segnali) e campi di applicazione (medicina, finanza, ingegneria, fisica), e allo stesso tempo capaci di scalare (in dimensione) da pochi nodi fino al centinaio di rack tipico dei più grandi calcolatori paralleli.

Proprio da questi nuovi requisiti nasce la necessità di sviluppare gli ormai prossimi sistemi centrati sui dati, meglio noti come Data Centric Systems (DCS). Questi sistemi ambiscono a superare i limiti dei calcolatori moderni ed in particolare a minimizzare il costoso (in termini di tempo ed energia) trasferimento dei dati da/verso la CPU, dove risiede l’unità di calcolo.

A differenza degli High Performance Computer (HPC) tradizionali, il cui sviluppo è da sempre stato orientato verso la pura prestazione di calcolo, intesa come numero di moltiplicazioni/addizioni in virgola mobile per unità di tempo (FLOPS) [4], i DCS saranno progettati per ottimizzare l’analisi di ogni forma di dato, e dovranno quindi tenere conto di molti più parametri.

In generale i nodi di un DCS saranno più densi, con un elevato numero di core e memoria cache condivisa, così da poter facilmente ripartire il lavoro tra centinaia (forse migliaia) di threads parallele, senza bisogno di duplicare alcun dato. Il processore sarà progettato per avere elevate prestazioni sia a livello della FPU (floating point unit) che della ALU (arithmetic logic unit), così da lavorare egregiamente anche con algoritmi a basso numero di FLOPS, quali ad esempio quelli di ricerca e ordinamento.

L’importanza di minimizzare la distanza tra dati e processore porterà all’installazione di unità di storage locali, ad alta prestazione e bassa latenza, come ad esempio schede NVMe di tipo Flash, accessibili tramite bus PCI-E. Simili prestazioni saranno richieste nel trasferimento di dati dalla memoria RAM classica a quella di acceleratori grafici, come ad esempio sta facendo Nvidia con la tecnologia NVLink [5].

Ricerca e innovazione per un futuro cognitivo

La ricerca scientifica avrà un ruolo fondamentale nel trovare soluzioni innovative che stravolgeranno il modo di pensare e progettare i DCS nel tempo. Si tratta delle cosiddette Disruptive Innovations, ovvero innovazioni che “distruggono” mercati e filosofie di progettazione consolidate a beneficio di nuove tecnologie migliori ed innovative. Un primo esempio potrebbero essere memorie RAM in grado di effettuare operazioni semplici (come addizione e moltiplicazione) direttamente sulla scheda di memoria stessa, senza trasferire i dati sul processore [6].

Questo consentirebbe di spostare il carico di lavoro direttamente dove i dati risiedono, riducendo i tempi di calcolo e conseguentemente i costi energetici. Un secondo esempio potrebbero essere speciali unità di calcolo a ridotta precisione (con poche cifre significative rispetto alle classiche quindici della doppia precisione), che fungeranno da velocissimi co-processori a basso consumo energetico. Queste unità alleggeriranno il carico di lavoro delle CPU, tagliando drasticamente il costo di tutte le fasi nelle quali un certo grado di approssimazione è tollerabile, senza compromettere la qualità e validità del risultato finale [7].

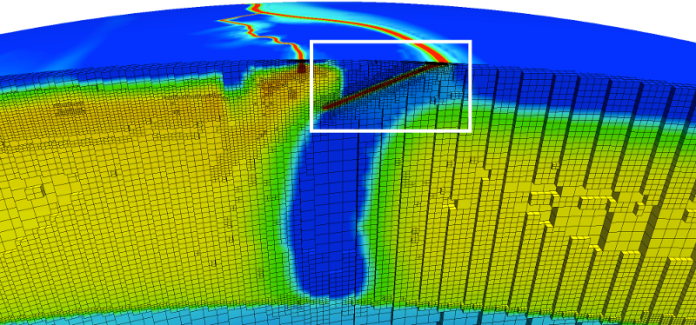

Nel prossimo decennio sarà finalmente possibile integrare i sistemi cognitivi di ultima generazione [8] con potenti exascale DCS. Questo accoppiamento consentirà di estrarre nuova conoscenza dalla più grande e inesauribile risorsa naturale del presente e del futuro: i dati. La capacità di analizzare dati fino ad allora fuori dalla portata di ogni sistema porterà enormi innovazioni e scoperte scientifiche in tutti i campi, quali ad esempio nuovi trattamenti per malattie e conseguente creazione di nuovi farmaci, progettazione di nuovi velivoli e mezzi di trasporto, scoperta di nuovi giacimenti di petrolio e gas, previsione dei cambiamenti climatici, scoperta di nuovi materiali e leghe, e molti altri ancora.

Bibliografia:

[1] Gill Press. 12 Big Data Definitions: What’s Yours? Forbes, 2014.

[2] The Zettabyte Era—Trends and Analysis. CISCO, 2015.

[3] CERN Computing.

[4] The Top500 ranking.

[5] Nvidia NVLink.

[6] Wabe Koelmans, Abu Sebastian, Vara P. Jonnalagadda, Daniel Krebs, Laurent Dellmann, Evangelos Eleftheriou. Projected phase-change memory devices. Nature Communications 6, Article number: 8181, 2015.

[7] Pavel Klavík, A. Cristiano I. Malossi, Costas Bekas, Alessandro Curioni. Changing computing paradigms towards power efficiency. Philosophical Transactions of the Royal Society A: Mathematical, Physical and Engineering Sciences 372(2018), 2014.

[8] Alessandro Curioni. Cognitive computing, il futuro della conoscenza. 01net 2016

[…] La nuova frontiera del supercalcolo: i Data Centric Systems […]