La WWDC, Worldwide Developers Conference, di Apple è un evento tutto dedicato a loro: gli sviluppatori. Oltre alle numerose novità annunciate sia in ambito hardware che software durante il keynote, quindi, non potevano che esserci anche gli strumenti di sviluppo sotto i riflettori, nel corso della annuale conferenza Apple.

Sono stati infatti numerosi anche i framework e le nuove tecnologie presentati da Apple, che consentiranno agli sviluppatori di creare app e soluzioni ancora più innovative.

A partire da SwiftUI, un framework di sviluppo che semplifica la creazione di interfacce utente.

SwiftUI velocizza lo sviluppo di app

Swift è il linguaggio di programmazione per lo sviluppo su macOS, iOS, watchOS, tvOS e ora anche iPadOS. L’obiettivo di Swift è da sempre quello di rendere lo sviluppo di app più veloce, facile e interattivo. Per raggiungere questo obiettivo, spiega Apple, è indispensabile un framework UI moderno.

Ecco che entra in gioco quest’ultima novità: SwiftUI offre un nuovo framework estremamente intuitivo che consente di realizzare interfacce utente complesse e potenti. Grazie a un codice dichiarativo semplice e di facile comprensione, gli sviluppatori possono dare vita a UI ricche di funzioni evolute e animazioni fluide.

SwiftUI permette di risparmiare tempo, promette Apple, poiché offre una grande quantità di funzioni automatiche fra cui layout dell’interfaccia, Modalità scura, Accessibilità, supporto per la scrittura da destra a sinistra e internazionalizzazione.

Le app SwiftUI vengono eseguite in modo nativo e pertanto si avvantaggiano della piena velocità di questa modalità. E dato che SwiftUI è la stessa API integrata in iOS, iPadOS, macOS, watchOS e tvOS, gli sviluppatori possono realizzare più rapidamente e facilmente app native per tutte le piattaforme Apple.

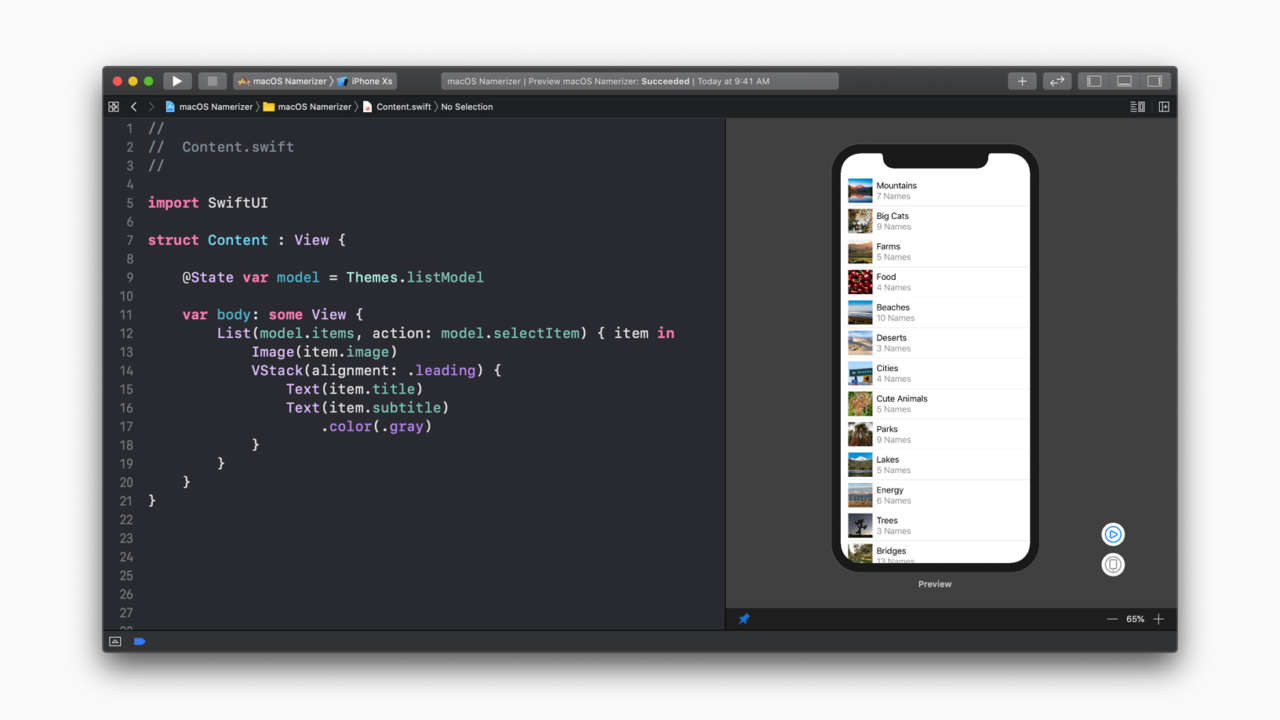

Xcode 11 e SwiftUI

Un nuovo strumento di design grafico dell’UI integrato in Xcode 11 consente di assemblare facilmente e velocemente un’interfaccia grafica con SwiftUI senza dover scrivere codice. Il codice Swift viene infatti generato automaticamente.

Quando viene modificato, gli aggiornamenti all’UI appaiono all’istante nello strumento di design. Ora gli sviluppatori possono visualizzare anteprime automatiche in tempo reale dell’aspetto e del comportamento della UI dell’app, man mano che assemblano, testano e perfezionano il codice.

Quando viene modificato, gli aggiornamenti all’UI appaiono all’istante nello strumento di design. Ora gli sviluppatori possono visualizzare anteprime automatiche in tempo reale dell’aspetto e del comportamento della UI dell’app, man mano che assemblano, testano e perfezionano il codice.

La possibilità di passare agevolmente dal design grafico alla compilazione di codice rende ancora più efficiente lo sviluppo di UI e consente una più stretta collaborazione fra sviluppatori di software e creatori di interfacce utente.

Le anteprime possono essere visualizzate direttamente sui dispositivi Apple connessi, come iPhone, iPad, iPod touch, Apple Watch e Apple TV: ciò permette agli sviluppatori di vedere come l’app reagisce al multi-touch o come funziona con la fotocamera e i sensori integrati. E possono farlo in tempo reale, direttamente mentre creano l’interfaccia.

Creare scenari di realtà aumentata e virtuale

ARKit 3 mette le persone al centro delle esperienze di realtà aumentata. Con Motion Capture, gli sviluppatori possono integrare i movimenti delle persone nelle loro app, mentre con People Occlusion, i contenuti di realtà aumentata appariranno in maniera naturale davanti o dietro le persone, per dare vita a esperienze più coinvolgenti.

ARKit 3 consente inoltre di tracciare fino a tre volti con la fotocamera frontale e offre supporto simultaneo per le fotocamere anteriore e posteriore. Fornisce anche sessioni collaborative, per passare più rapidamente a un’esperienza di realtà aumentata condivisa.

ARKit 3 consente inoltre di tracciare fino a tre volti con la fotocamera frontale e offre supporto simultaneo per le fotocamere anteriore e posteriore. Fornisce anche sessioni collaborative, per passare più rapidamente a un’esperienza di realtà aumentata condivisa.

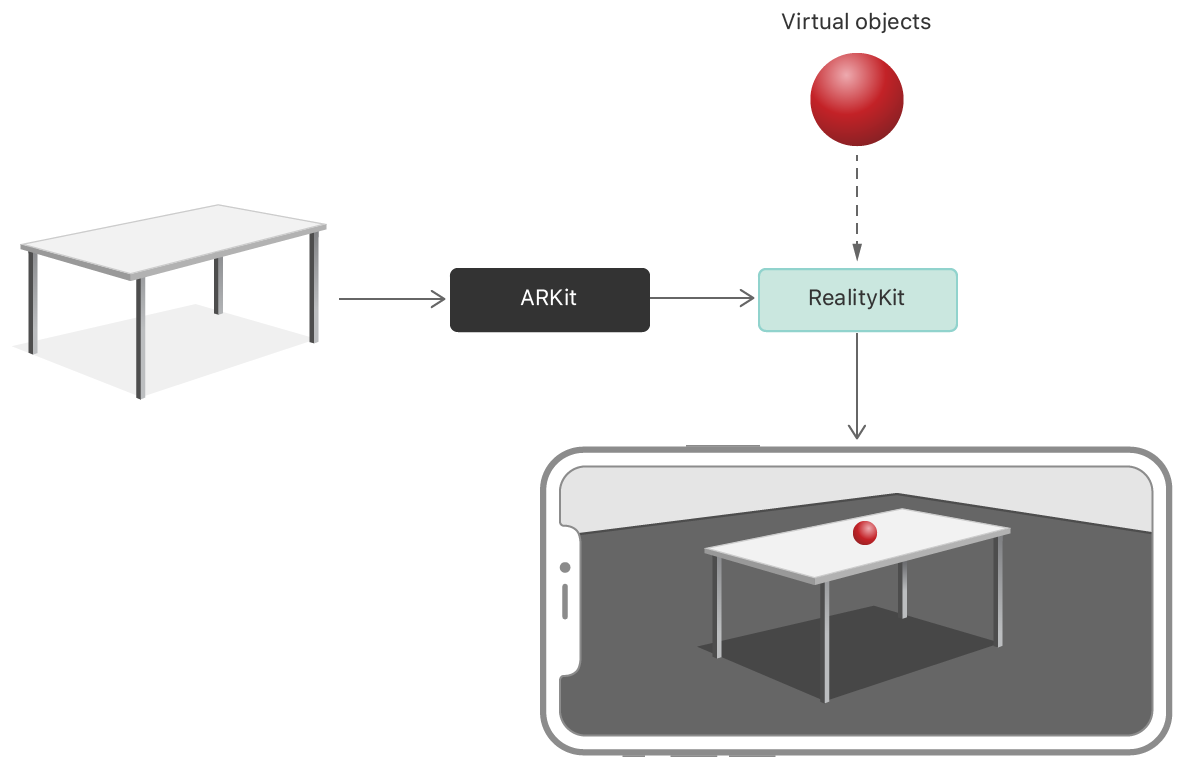

RealityKit è un framework realizzato appositamente per la realtà aumentata. Offre un rendering fotorealistico, oltre alla mappatura ambientale e il supporto per gli effetti della fotocamera come rumore e sfocatura, per rendere i contenuti virtuali pressoché indistinguibili dalla realtà.

RealityKit presenta inoltre strumenti per animazioni, fisica e audio spaziale. Gli sviluppatori possono sfruttare le capacità di RealityKit con la nuova API Swift RealityKit. Reality Composer, una nuova app per iOS, iPadOS e Mac, consente di prototipare e realizzare facilmente esperienze di realtà aumentata anche agli sviluppatori che non hanno esperienza con il 3D.

RealityKit presenta inoltre strumenti per animazioni, fisica e audio spaziale. Gli sviluppatori possono sfruttare le capacità di RealityKit con la nuova API Swift RealityKit. Reality Composer, una nuova app per iOS, iPadOS e Mac, consente di prototipare e realizzare facilmente esperienze di realtà aumentata anche agli sviluppatori che non hanno esperienza con il 3D.

Grazie a un’intuitiva interfaccia drag-and-drop e una libreria di oggetti 3D e animazioni di alta qualità, Reality Composer permette di posizionare, spostare e ruotare oggetti AR per dare vita a un’esperienza di realtà aumentata, che può essere integrata direttamente in un’app in Xcode o esportata in AR Quick Look.

Da iPad a Mac il percorso è breve

Nuovi strumenti di sviluppo e API semplificano notevolmente il passaggio di app iPad sulla piattaforma Mac.

Con Xcode, gli sviluppatori possono aprire un progetto iPad e, spuntando una semplice casella, aggiungere in automatico funzioni specifiche per Mac e capacità di windowing, nonché adattare elementi peculiari della piattaforma, come i controlli touch, all’utilizzo tramite tastiera e mouse. In questo modo potranno realizzare più facilmente la versione Mac nativa della loro app.

Le app Mac e iPad condividono lo stesso progetto e lo stesso codice sorgente, perciò tutte le modifiche apportate al codice si traducono sia nella versione per iPadOS che nella versione per macOS dell’app. Gli sviluppatori risparmieranno così tempo e risorse preziose, dato che un unico team può lavorare su entrambe le versioni.

Le app Mac e iPad condividono lo stesso progetto e lo stesso codice sorgente, perciò tutte le modifiche apportate al codice si traducono sia nella versione per iPadOS che nella versione per macOS dell’app. Gli sviluppatori risparmieranno così tempo e risorse preziose, dato che un unico team può lavorare su entrambe le versioni.

Avere le stesse versioni sia per Mac che per iPad consente agli utenti di utilizzare le loro app preferite sfruttando le peculiarità di ogni piattaforma, incluse la precisione e la velocità di tastiera, mouse e trackpad sul Mac e le funzioni specifiche del Mac come la Touch Bar.

Core ML e Create ML, machine learning diApple

Core ML 3 supporta l’accelerazione di più tipi di modelli di machine learning evoluti in tempo reale. Con oltre 100 livelli ora supportati in Core ML, le app possono usare modelli all’avanguardia per offrire esperienze che comprendono a fondo concetti visivi, vocali e legati al linguaggio naturale.

Inoltre, per la prima volta gli sviluppatori possono aggiornare i modelli di apprendimento automatico direttamente sul dispositivo grazie alle opzioni di personalizzazione. Questa tecnica all’avanguardia offre agli sviluppatori l’opportunità di fornire funzioni personalizzate senza compromettere la privacy dell’utente.

Inoltre, per la prima volta gli sviluppatori possono aggiornare i modelli di apprendimento automatico direttamente sul dispositivo grazie alle opzioni di personalizzazione. Questa tecnica all’avanguardia offre agli sviluppatori l’opportunità di fornire funzioni personalizzate senza compromettere la privacy dell’utente.

Con Create ML, un’app dedicata allo sviluppo di soluzioni di machine learning, è possibile realizzare modelli di apprendimento senza bisogno di compilare codice. Gli sviluppatori possono usare il training a modelli multipli con diversi set di dati per questi nuovi tipi di modelli, come rilevamento degli oggetti, attività e classificazione sonora.

Apple Watch, il polso dello sviluppo

Con l’introduzione di watchOS 6 e dell’App Store su Apple Watch, gli sviluppatori possono ora progettare e realizzare app per Apple Watch che operano in maniera del tutto indipendente, anche senza iPhone.

Possono inoltre sfruttare il Neural Engine di Apple su Apple Watch Series 4 usando Core ML. Grazie all’integrazione di modelli con training Core ML nelle app e all’interpretazione on-device degli input, gli utenti potranno avere a disposizione app ancora più smart.

Una nuova API di streaming audio permette di riprodurre contenuti in streaming dalle app multimediali di terze parti direttamente da Apple Watch. Una API di runtime esteso offre alle app più tempo per portare a termine attività su Apple Watch mentre l’app è ancora in primo piano, anche se lo schermo è spento: per esempio l’accesso ai sensori consentiti per battito cardiaco, posizione e movimento.

Una nuova API di streaming audio permette di riprodurre contenuti in streaming dalle app multimediali di terze parti direttamente da Apple Watch. Una API di runtime esteso offre alle app più tempo per portare a termine attività su Apple Watch mentre l’app è ancora in primo piano, anche se lo schermo è spento: per esempio l’accesso ai sensori consentiti per battito cardiaco, posizione e movimento.

Con Sign In with Apple, l’accesso è privato

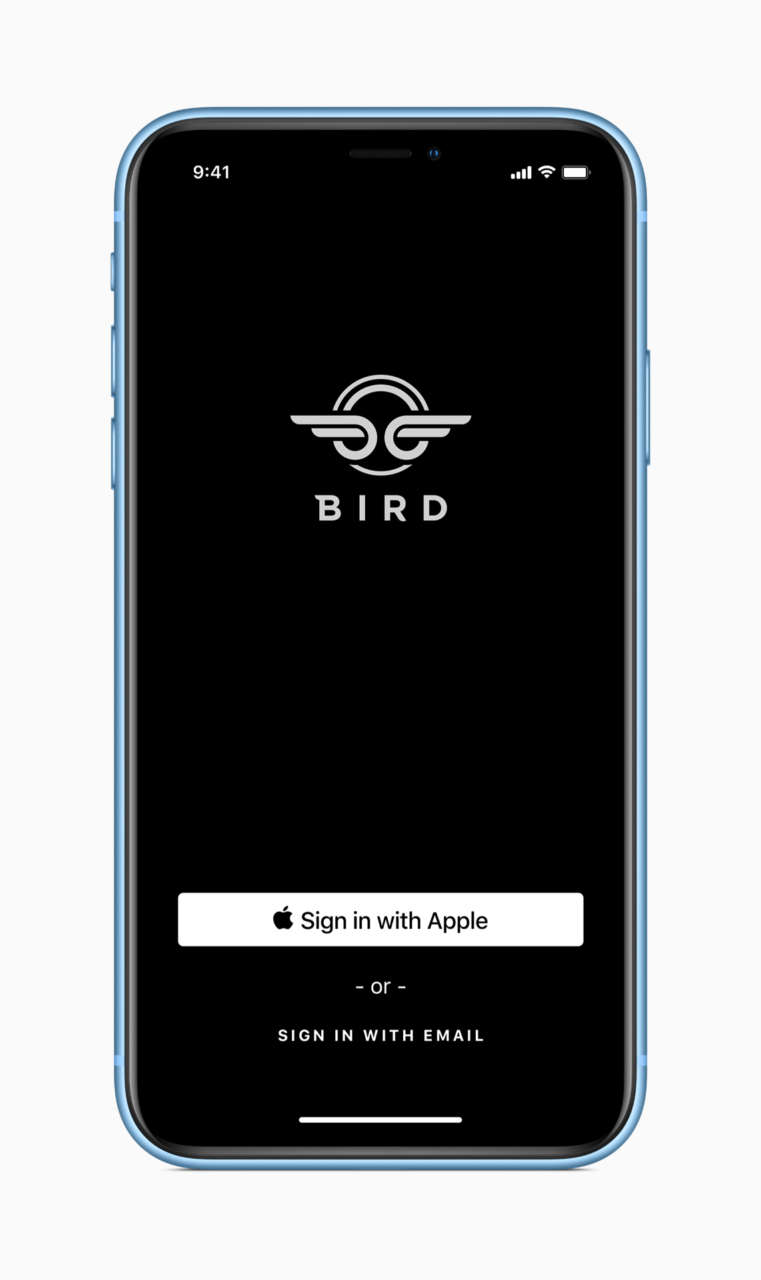

Sign In with Apple è la nuova soluzione che consente agli utenti di accedere facilmente a siti web e app con il loro ID Apple.

Anziché compilare un modulo, verificare l’indirizzo email o scegliere una password, i clienti possono usare il loro ID Apple per configurare un account e iniziare subito a usare l’app. Viene così migliorato il time to engagement dell’utente.

Dato che tutti gli account sono protetti tramite un’autenticazione a due passaggi, Sign In with Apple permette agli sviluppatori di migliorare la sicurezza delle app. Include inoltre una nuova funzione antifrode che offre ai creatori di software la certezza che i nuovi utenti siano persone reali, e non bot o account “farmed”.

Dato che tutti gli account sono protetti tramite un’autenticazione a due passaggi, Sign In with Apple permette agli sviluppatori di migliorare la sicurezza delle app. Include inoltre una nuova funzione antifrode che offre ai creatori di software la certezza che i nuovi utenti siano persone reali, e non bot o account “farmed”.

Grazie a un nuovo servizio di trasmissione email incentrato sulla privacy, gli utenti possono ricevere messaggi importanti dallo sviluppatore dell’app senza dover divulgare il loro indirizzo email personale. E poiché Apple non traccia le attività degli utenti nelle app e non crea un profilo dell’utilizzo delle app, le informazioni sul business dello sviluppatore e sui suoi utenti restano private.

Un ricco menu per i programmatori

Tra le altre novità messe in campo da Apple per gli sviluppatori, c’è PencilKit, che consente di aggiungere facilmente il supporto per Apple Pencil nelle app e include anche una nuova palette di strumenti.

SiriKit aggiunge il supporto per app audio di terze parti, incluse app per musica, podcast e audiolibri; gli sviluppatori possono ora integrare Siri direttamente nelle loro app per iOS, iPadOS e watchOS, offrendo agli utenti la possibilità di controllare l’audio con un semplice comando vocale.

MapKit offre ora agli sviluppatori nuove funzioni quali overlay vettoriali, filtri per punti di interesse, limiti a zoom e panoramica e supporto per la Modalità scura.

In aggiunta ai miglioramenti del linguaggio mirati a SwiftUI, Swift 5.1 aggiunge Module Stability, le fondamenta essenziali per realizzare framework compatibili a livello binario in Swift.

Le nuove famiglie di dispositivi Metal semplificano la condivisione di codice fra più tipi di GPU su tutte le piattaforme Apple, mentre il supporto per iOS Simulator rende ancora più facile sviluppare app Metal per iOS e iPadOS.