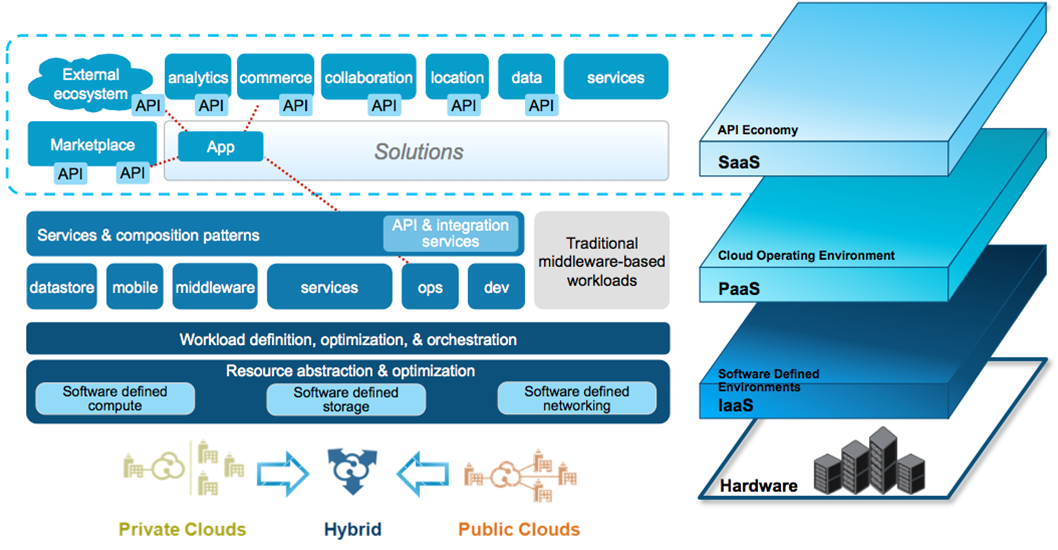

Il cloud e l’intelligenza artificiale rappresentano il trend in questo momento in cui le imprese sono più esigenti e ricche di aspettative e fanno spazio alle infrastutture software defined.

Le aziende tendono a spingere e trasformare applicazioni legacy verso ambienti Ibridi per abilitare le proprie infrastrutture Ict ad una gestione intelligente e business-driven, tramite un approccio per la gestione integrata delle risorse eterogenee virtualizzate.

Concretamente, secondoi Giancarlo Marino, manager del software presso Ibm, ci stiamo spostando da un mondo rigido e ben strutturato, verso un mondo in cui vince chi offre un contenuto personalizzato con un numero di informazioni non strutturato.

Vince, insomma, chi riesce a rendere disponibili e utilizzabili i miliardi di informazioni e, nel caso della sicurezza, non reagisce all’ insidia ma è proattivo e si difende in anticipo.

Questo scenario porta le aziende verso il nuovo mondo software defined dove un’applicazione viene elaborata in differenti infrastrutture (cloud, hybrid, in house in mainframe o server) ed è anche distribuita attraverso reti differenti, fruita attraverso diversi device e relativi sistemi operativi.

Questi ambienti complessi ed articolati, con molte componenti, molte dipendenze ed estremamente dinamici sono piu’ difficili da pianificare e misurare per avere un controllo ed una gestione efficace.

In questo contesto le performance sono di fondamentale importanza, in quanto determinano la qualità del servizio offerto agli utenti sui nuovi canali di interazione.

I livelli di SLA (Service Level Agreements) devono essere equivalenti a quelli delle attuali applicazioni legacy.

Ancora più importante è, secondo Marino, che le aziende si dotino di un avanzato Application Performance Monitoring (APM) per garantire che le applicazioni e i servizi siano conformi agli SLA.

Non è facile, come nei tradizionali e consolidati modelli IT, monitorare efficacemente le prestazioni a livello applicativo, perché le architetture sono sempre piu’ multilivello (vari livelli di stack del protocollo internet e quelli legati alle transazioni, database e middleware).

Occorre che I vari fornitori, ed alcuni lo stanno già facendo, ridefiniscano e facciano evolvere l’APM delle reti tradizionali, verso i progressi delle tecnologie Internet, per la realizzazione di un APM futuristico per Software Defined Networks (SDN).

Le dimensioni dell’Application Performance Monitoring

L’approccio dovrà tenere conto delle dimensioni di Gartner dell’APM, nello scenario SDN che sono:

1) Monitoraggio dell’End User Experience.

2) Rilevamento, modellazione e visualizzazione dell’architettura dell’applicazione di runtime.

3) Profilazione della transazione definita dall’utente.

4) Monitoraggio approfondito dei componenti in un contesto applicativo.

5) Reporting e analisi dei dati delle applicazioni

Seguire queste dimensioni permetterà di avere performance chiare dei vari livelli dello stack dei protocolli internet, permettendo in questo modo il monitoraggio ad esempio dell’ ampiezza di banda e dell’ applicazione stessa per essere conformi agli SLA richiesti.

Il monitoraggio dell’ampiezza di banda renderà meno difficoltoso trovare la root case delle applicazioni impattate

Lo scopo di queste dimensioni comunque non è solo quello di garantire la conformità SLA, ma anche di tracciare le transazioni, diagnosticare errori, prevenire interruzioni.

Questa nuova visione delle performance va accompagnata ad un’azione tangibile guidata dagli analitycs ed i progressi nell’ intelligenza artificiale e del machine learning offrono da questo punto di vista nuove importanti opportunità.

Ad esempio Ibm vuole portare anche nel cloud privato i propri modelli analitici: ha infatti isolato la tecnologia al cuore del machine learning di Watson, per portarla là dove risiedono la maggior parte dei dati aziendali critici e cioè sui suoi server Enterprise di eccellenza zSystem, macchine in grado di elaborare fino a 2,5 miliardi di transazioni.

Otre alle performance le aziende devono sempre più dare importanza e priorità alle soluzioni storage software defined per le applicazioni e i carichi di lavoro cognitivi, legati all’Intelligenza Artificiale e in ambito multi-cloud.

Queste soluzioni utilizzano la gestione dei workload e delle risorse intelligenti policy-driven per ottimizzare tutte le risorse nei data center, on premise e nel cloud.

Le ultime soluzioni offrono gli ultimi progressi nel campo dell’infrastruttura software defined, ora scalabile fino a più di 160.000 core, per consentire di sfruttare al massimo la potenza delle applicazioni mission critical HPC (High Performance Computing), di analytics e big data (fino a 150 volte più veloci), oltre a una nuova generazione di framework open source come Hadoop e Spark