Per molto tempo lo scenario tecnologico dei datacenter è apparso abbastanza statico in quanto ad evoluzione dei processori e delle architetture. Oggi le cose sono un po’ diverse, soprattutto perché il datacenter è lo snodo chiave dei processi evolutivi delle imprese: che sia esterno o interno all’azienda, è da lì che sono erogati i servizi che permettono di far evolvere il business. Anche a livello di CPU bisogna tenere conto di questa criticità e la risposta di Intel a questa esigenza sono i nuovi processori Xeon Skylake-SP (o Scalable Processor).

È ovvio che il maggiore dinamismo in campo datacenter è legato anche a temi tecnologici che ci hanno portati al di là del modello classico “dual Xeon”. Diversi hyperscaler non hanno particolari problemi a seguire in prima persona strade alternative nella progettazione, parallelamente le piattaforme ARM e soprattutto AMD stanno facendo importanti passi in avanti. Intel ha deciso di dare un sensibile cambio di passo e per questo i nuovi Xeon Skylake-SP si distinguono per una concezione “olistica” che punta a migliorare insieme tanto la capacità di calcolo quanto la gestione della memoria e dei flussi di input/output. Quindi insieme computing, storage e networking.

Ma dato che si tratta di processori, anche per gli Xeon Skylake-SP bisogna comunque partire dalla microarchitettura e dalle caratteristiche collegate. In questo senso le novità principali sono un nuovo sistema di interconnessione dei (molti) core delle CPU, una nuova suddivisione della memoria cache e il supporto alle istruzioni AVX-512.

La microarchitettura Xeon Skylake-SP

Tradizionalmente i core di un processore Xeon sono collegati fra loro, con le cache, i memory controller e la parte di I/O attraverso un doppio “anello” a bassa latenza. Una strada efficace ma che diventa un limite al crescere del numero di core. E oggi nel datacenter bisogna invece presentarsi con un alto numero di core.

Così per gli Xeon Skylake-SP il sistema di interconnessione interno al processore è una rete mesh che consente di mantenere bassa la latenza di comunicazione pur gestendo un numero superiore di core e garantendo una maggiore scalabilità potenziale.

Collegata in parte alla rivisitazione della microarchitettura è la riprogettazione della memoria cache, che vede crescere la parte L2 a danno della cache L3. L’obiettivo è garantire una maggiore efficienza per le operazioni dei core e da qui viene il maggiore “peso” dato alla cache L2, mentre la riduzione della cache L3 è in parte compensata dal suo essere non-inclusiva, evitando quindi duplicazioni di informazioni

Collegata in parte alla rivisitazione della microarchitettura è la riprogettazione della memoria cache, che vede crescere la parte L2 a danno della cache L3. L’obiettivo è garantire una maggiore efficienza per le operazioni dei core e da qui viene il maggiore “peso” dato alla cache L2, mentre la riduzione della cache L3 è in parte compensata dal suo essere non-inclusiva, evitando quindi duplicazioni di informazioni

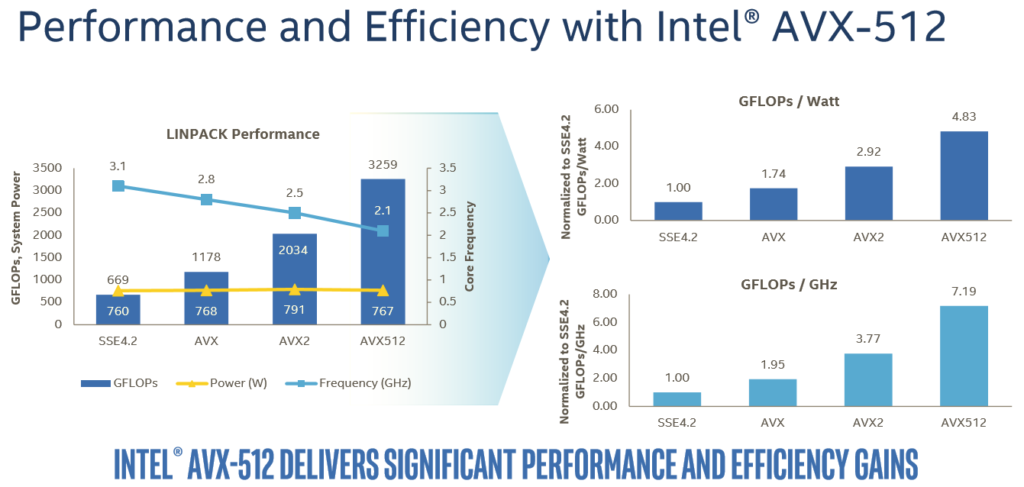

Dal punto di vista delle istruzioni, l’adozione di AVX-512 influisce positivamente non solo sulla capacità di calcolo ma soprattutto sull’efficienza energetica, ossia sulla potenza di calcolo per Watt o per GHz degli Xeon Skylake-SP. Questo permette di consumare meno o di operare a frequenze operative più basse a parità di prestazioni, un elemento importante quando si tratta di datacenter. L’altro lato della medaglia è che questi miglioramenti si hanno solo per il codice che supporta AVX-512, un tema che però interessa più la parte software di Intel e il suo lavoro su librerie e compilatori.

Dai transistor alla pratica

In cosa tutta questa tecnologia si traduce dal punto di vista degli utenti finali? Nel complesso le prestazioni dei nuovi Xeon Skylake-SP secondo Intel sono mediamente superiori del 60 percento alla generazione precedente Xeon. Questo in media, poi la casa indica miglioramenti nettamente superiori per compiti particolari come la gestione delle macchine virtuali, il deep learning o i carichi transazionali. Dipenderà, ovviamente, da caso a caso.

Questa appena annunciata è anche una microarchitettura che definisce una linea evolutiva nuova, con l’integrazione dentro le CPU di componenti prima esterni in modo da garantire maggiori prestazioni (qui ad esempio la parte della cifratura e del networking a maggiore banda). Il processore da questo punto di vista diventa un “sistema” che si adatta al tipo di workload integrando magari più memoria o – in futuro – parti programmabili legate alle tecnologie di Altera.

Questa appena annunciata è anche una microarchitettura che definisce una linea evolutiva nuova, con l’integrazione dentro le CPU di componenti prima esterni in modo da garantire maggiori prestazioni (qui ad esempio la parte della cifratura e del networking a maggiore banda). Il processore da questo punto di vista diventa un “sistema” che si adatta al tipo di workload integrando magari più memoria o – in futuro – parti programmabili legate alle tecnologie di Altera.

C’è anche, il che non guasta, una maggiore semplicità. Invece di avere le due famiglie E5 (mainstream) ed E7 (performance) c’è una piattaforma unica (Purley) pronta pr la generazione odierna Skylake ma anche per la successiva Cascade Lake. Con una suddivisione “di marketing” Bronze-Silver-Gold-Platinum che dovrebbe essere più chiara per i vari livelli di potenza e funzioni.

Anche se poi è sempre meglio sapersi districare tra i vari numeri di versione e le dotazioni in quando a numero di ore (massimo 28) e frequenze operative (massimo 3,6 GHz ma per i modeli con pochi core). Elemento importante: con i nuovi Xeon Skylake-SP si possono progettare macchine sino a 8 socket, il che garantisce un elevato spazio di manovra ai designer di server.