Fujitsu ha annunciato importanti novità nell’ambito della tecnologia deep learning, sviluppando un nuovo e molto efficiente meccanismo di distribuzione della memoria per i Deep Neural Networks (DNNs).

Ampiamente utilizzato per molte applicazioni nel campo dell’intelligenza artificiale come il riconoscimento e la classificazione di un discorso e di un oggetto, l’utilizzo avanzato di DNN richiede enormi risorse computazionali, che incidono pesantemente sulle infrastrutture informatiche esistenti.

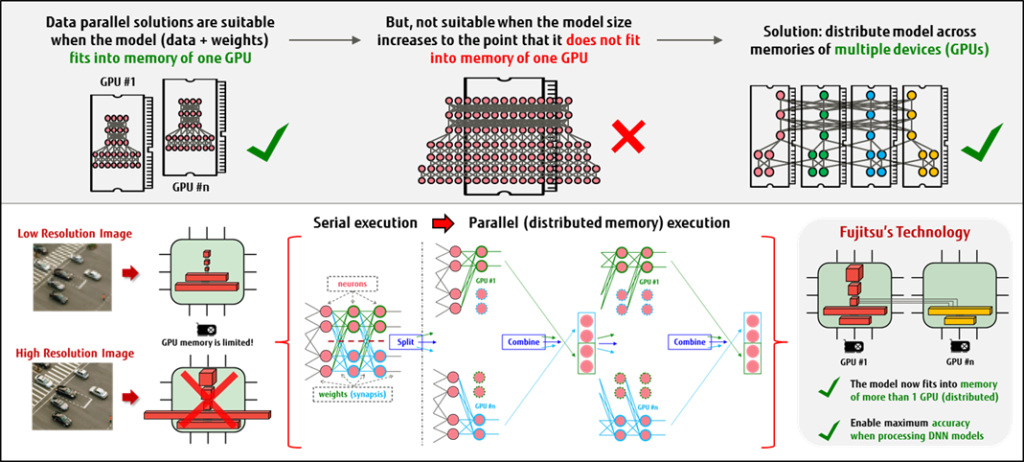

Con la nuova soluzione sviluppata dai laboratori europei di Fujitsu, il parallelismo del modello impiegato viene utilizzato per distribuire i requisiti di memoria DNN in modo automatizzato, trasparente e facilmente gestibile. Di conseguenza, la capacità delle infrastrutture esistenti nell’affrontare applicazioni AI su larga scala è notevolmente migliorata senza la necessità di ulteriori investimenti.

La nuova soluzione riesce ad ottenere una distribuzione ottimizzata della memoria perchè trasforma gli strati di reti neurali, arbitrariamente progettate, in reti equivalenti in cui alcuni o tutti i suoi strati sono sostituiti da una serie di sotto-strati più piccoli.

Queste sono progettate per essere funzionalmente equivalenti agli strati originali, ma sono molto più efficienti da eseguire dal punto di vista computazionale. Importante notare che, poiché gli strati originali e quelli nuovi derivano dal medesimo profilo, il processo di formazione del DNN trasformato converge a quello del DNN originale senza alcun costo aggiunto.

Framework opensource di deep learning

I laboratori europei di Fujitsu hanno testato a lungo la nuova tecnologia, inclusa l’applicazione del nuovo meccanismo in «Caffe», un framework opensource di deep learning ampiamente utilizzato dalle comunità di ricerca e sviluppo in tutto il mondo.

La soluzione ha raggiunto un’efficienza di oltre il 90% nella distribuzione della memoria nel momento in cui vengono trasformati gli strati completamente collegati di AlexNet su più GPU NVIDIA.

Come tecnologia indipendente da hardware, ha la capacità di sfruttare la potenza computazionale di entrambe le unità di elaborazione convenzionali e di acceleratori hardware in fase di sviluppo, inclusi NVIDIA GPU, Intel Xeon Phi, FPGA, ASIC o qualsiasi altro hardware alternativo specificamente adattati per aumentare l’efficienza computazionale nel deep learning.

Casi di utilizzo

Esempi di applicazioni per la nuova soluzione comprendono l’analisi nel settore healthcare (ad esempio la rilevazione della retinopatia diabetica), la classificazione e l’analisi delle immagini satellitari, l’elaborazione linguistica naturale (dove sono necessari modelli di deep learning su larga scala per modellare e apprendere la completa complessità del linguaggio umano), dati su larga scala relativi a dispositivi IoT, transazioni finanziarie, servizi di social network.

Laboratori di deep learning

I laboratori europei di Fujitsu sono centro di eccellenza per le ricerche avanzate sul machine learning e il deep learning, nell’ambito delle soluzioni digitali e dei servizi sviluppati all’interno dell’iniziativa Human-Center AI di Fujitsu, denominata Zinrai.

La sua attività comprende un’ampia collaborazione e una co-creazione con i clienti Fujitsu e le organizzazioni di ricerca in tutta l’area EMEIA, tra cui San Carlos Clinical Hospital di Madrid (con la soluzione HIKARI AI), l’Università di Siviglia (analisi dati per le applicazioni turistiche) e il 5G Innovation Center nel Regno Unito.