Parlando con le aziende che adottano l’intelligenza artificiale (AI) nei loro team di sviluppo, emerge uno schema chiaro: oltre al sincero entusiasmo per le nuove possibilità e la rapidità di adattamento, molto spesso esprimono preoccupazioni che rallentano l’adozione dell’AI.

“A volte non fa quello che voglio e non capisco perché”

“Non funziona bene per le esigenze specifiche del nostro settore”

“Non ci permettono di usarla per problemi di conformità”

“Non mi fido a inviare il nostro codice a una scatola nera nel cloud”

Queste preoccupazioni indicano un problema più profondo: l’AI sta cambiando il mondo dello sviluppo del software e gli sviluppatori perdono il controllo degli strumenti su cui fanno affidamento. Sempre più spesso, i flussi di lavoro principali vengono definiti da sistemi opachi di proprietà di una manciata di fornitori, le cui priorità non sempre coincidono con quelle degli sviluppatori e delle loro organizzazioni.

Due percorsi divergenti: abbracciare o preservare

Poste davanti alla scelta fra le promesse dell’AI e l’esigenza di controllo, le organizzazioni si dividono tipicamente in due fazioni.

Alcune, soprattutto quelle nei settori meno regolamentati, adottano tool AI proprietari con piena convinzione. Le loro priorità sono velocità e produttività e sono pronte ad accettare sistemi “a scatola chiusa” nonostante i timori per il controllo a lungo termine.

Altre procedono con maggiore cautela. Operando spesso in settori delicati o specializzati, sono restie ad affidare codice e flussi di lavoro a piattaforme esterne opache, nonostante il timore di restare indietro rispetto a concorrenti che agiscono più velocemente.

Questo articolo analizza queste preoccupazioni e spiega come le organizzazioni possono accedere ai benefici dell’AI senza sacrificare sicurezza, adattabilità o sovranità, utilizzando strumenti AI open-source come alternativa sostenibile ai sistemi chiusi.

L’erosione silenziosa della sovranità dello sviluppatore

Per molti decenni gli strumenti di sviluppo hanno preservato i valori di trasparenza, modificabilità e controllo dell’utente. Era assolutamente normale comprendere, controllare e personalizzare il loro funzionamento, che fossero strumenti open-source o commerciali.

L’integrazione dell’AI sta cambiando le cose. Gli strumenti odierni funzionano sempre più spesso come “scatole nere” nelle quali gli sviluppatori perdono visibilità su:

- Quale codice e quali dati vengono inviati a terze parti

- Quali modelli elaborano il codice e i dati e dove

- Come l’AI interpreta le richieste e genera le risposte

- Dove viene inserita la proprietà intellettuale all’interno della base di codice

- L’origine e la legalità del codice generato

Se da un lato i guadagni di produttività sono tangibili, dall’altro questa opacità mina la fiducia, limita l’adattabilità e introduce rischi gestionali e tecnici in termini di sicurezza, conformità e innovazione.

Sicurezza e conformità

Gli strumenti AI basati sul cloud sollevano grandi preoccupazioni in materia di sicurezza e conformità, soprattutto in settori regolamentati come finanza, sanità e pubblica amministrazione. Se il codice viene inviato a sistemi esterni, come fanno le organizzazioni ad assicurarsi che i dati sensibili non vengano esposti o utilizzati in modo improprio?

La maggior parte dei servizi AI proprietari non offre trasparenza su ciò che viene elaborato, su come viene maneggiato e dove va a finire. Inoltre, questi sistemi tendono a non essere conformi alla normativa GDPR.

L’opacità è spesso insita nella loro progettazione. I fornitori di soluzioni proprietarie usano sistemi chiusi per proteggere i loro modelli di business, solitamente basati su abbonamenti per accedere a modelli o API. Poiché molti modelli LLM fondazionali sono disponibili pubblicamente o “commoditizzati”, il valore reale (e il margine) risiede nello “strato” di strumenti che avvolge questi modelli. Se i fornitori aprono la carta che avvolge il modello, la loro differenziazione scompare e i loro prodotti diventano facili da copiare. Svelando i meccanismi interni diventerebbe anche più difficile applicare diverse fasce di prezzo o limiti di utilizzo. Quindi, invece di essere viste come benefici, la trasparenza e l’apertura vengono considerate come rischi per la loro strategia di business.

Gli strumenti AI open-source risolvono questo problema consentendo l’esecuzione dei modelli in locale o all’interno di un’infrastruttura affidabile, in modo che i team abbiano pieno controllo su quali dati vengono utilizzati e come vengono manipolati.

Una multinazionale di ingegneria non poteva usare l’AI in alcun modo a causa delle restrizioni imposte per garantire la conformità. Tutto è cambiato con Theia AI, un framework aperto promosso da Eclipse Foundation che supporta l’esecuzione locale dei modelli. Dopo aver verificato che tutto girasse sui laptop degli sviluppatori, l’azienda ha finalmente liberato il potenziale di produttività sostenuta dall’AI, con la certezza che, così facendo, non avrebbero inviato codice al di fuori del firewall aziendale.

Eclipse Foundation

Eclipse Foundation è la fondazione che gestisce Eclipse IDE, Adoptium, Software Defined Vehicle, Jakarta EE e oltre 420 progetti open-source, fra cui runtime, tool, specifiche e framework per applicazioni cloud ed edge, IoT, AI, automotive, ingegneria dei sistemi, progetti di processori aperti e molte altre iniziative. Con quartier generale a Bruxelles, Eclipse Foundation è un’associazione internazionale senza scopo di lucro sostenuta da oltre 300 membri.

Adattabilità e personalizzazione

I team di sviluppo possono utilizzare flussi di lavoro molto diversi fra loro. Quello che funziona per un team di front-end potrebbe non funzionare per sistemi embedded o strumenti per settori specifici. Eppure, gli strumenti AI proprietari sono concepiti per usi generici e spesso falliscono in contesti specializzati.

La mancanza di adattabilità a contesti più specializzati può diventare velocemente un ostacolo e ridurre drasticamente il potenziale dell’AI. La maggior parte delle piattaforme aperte non supporta una pronta personalizzazione, adattando gli agenti per specifici flussi di lavoro, o l’integrazione con editor o linguaggi per settori specifici.

Gli strumenti AI aperti e personalizzabili consentono ai team di evolversi da adattamenti rapidi elementari alla selezione dei modelli LLM e alla piena integrazione con i flussi di lavoro. Che si tratti di adattare suggerimenti del codice a vincoli hardware specifici o incorporare politiche di sicurezza direttamente nella logica di generazione, gli strumenti personalizzabili liberano tutto il potenziale dell’AI.

I tool generici spesso ignorano casi d’uso reali che potrebbero non interessare al mercato più ampio, come modellazione visuale, ambienti di configurazione e linguaggi per settori specifici. Se prendiamo l’esempio di chi ha adottato la piattaforma Eclipse Tools, esiste una miriade di strumenti focalizzati sulla configurazione (di hardware o sistemi), sulla progettazione (di prodotti, oggetti virtuali come processi o, nuovamente, hardware), oppure sulla programmazione in linguaggi settoriali, inclusi quelli grafici. Tutti questi aspetti sono attualmente ignorati dalle principali soluzioni proprietarie chiuse. Inoltre, a causa dell’architettura proprietaria lontana dal concetto di piattaforma, sono semplicemente inadeguati per creare offerte di strumenti mirati.

Le piattaforme open-source possono aiutare a risolvere l’esclusione dei casi d’uso meno diffusi dalla rivoluzione dell’AI offrendo una base sia personalizzabile sia estensibile. Queste piattaforme consentono agli sviluppatori di adattare il comportamento dell’assistente AI agli elementi specifici del loro ambito, come DSL, strumenti di modellazione grafica ed editor di configurazione. Poiché queste piattaforme sono progettate per essere modulari e aperte, è possibile integrare l’AI strettamente con strumenti per modellare hardware, processi o stack software personalizzati. Invece di produrre semplicemente “codice”, l’assistente si adatta all’ambito e al linguaggio dell’utente.

Vincolo al fornitore

Il vincolo è sempre stato un rischio per gli strumenti di sviluppo, ma l’AI sta aggravando la situazione. Gli sviluppatori fanno sempre più affidamento su agenti AI proprietari per scrivere, rifattorizzare e revisionare il codice, pur non avendo alcun controllo su come operano questi agenti. È come esternalizzare il team di sviluppo presso una terza parte che potrebbe scomparire o cambiare le proprie condizioni in qualsiasi momento.

Risultato? Dipendenza strategica. Si potrebbero perdere mesi di investimenti nei flussi di lavoro per adeguarli e integrarli nei propri processi di sviluppo se la piattaforma di strumenti chiusa si evolve nella direzione sbagliata. Intere pipeline di sviluppo potrebbero incepparsi quando cambiano le licenze, viene revocato l’accesso o le prestazioni variano in modo inaspettato a causa di aggiornamenti dei modelli a monte.

Per contro, i tool AI aperti assicurano che gli agenti AI facciano parte del tuo team. Tu controlli i flussi di lavoro, i modelli e i dati. Tu puoi far evolvere il sistema, revisionarlo e persino cambiare componenti alle tue condizioni senza ripartire da zero. In questo contesto, gli strumenti aperti non solo evitando il “lock-in”, ma aiutano anche a mantenere la proprietà delle proprie capacità di ingegnerizzazione. E questo è un vantaggio competitivo che nessun fornitore ti potrà togliere.

Innovazione

Gli strumenti per gli sviluppatori hanno una caratteristica unica nell’ecosistema software: sono fatti dalla stessa materia che contribuiscono a creare. Questa riflessività fa sì che gli sviluppatori non siano solo utilizzatori dei loro strumenti. Hanno anche la possibilità unica di migliorarli ed estenderli. A differenza della maggior parte degli altri settori, dove gli strumenti sono ben distinti dai risultati, nello sviluppo di software la distinzione è più sfumata. Questo rapporto speciale ha sempre alimentato l’innovazione, poiché gli sviluppatori cercano naturalmente di ottimizzare gli ambienti in cui essi stessi lavorano.

Le piattaforme AI chiuse interrompono questo ciclo di feedback. Se i comportamenti chiave, ad esempio la composizione di prompt (istruzioni) e i flussi agenziali, restano nascosti dietro le API, gli sviluppatori diventano utilizzatori passivi invece che innovatori attivi. Gli strumenti AI aperti e trasparenti rivendicano questo potere, consentendo agli sviluppatori di sperimentare, estendere e ottimizzare liberamente. Intere comunità possono iterare reciprocamente sui rispettivi lavori, promuovendo l’innovazione molto più velocemente di quanto potrebbe fare qualsiasi fornitore.

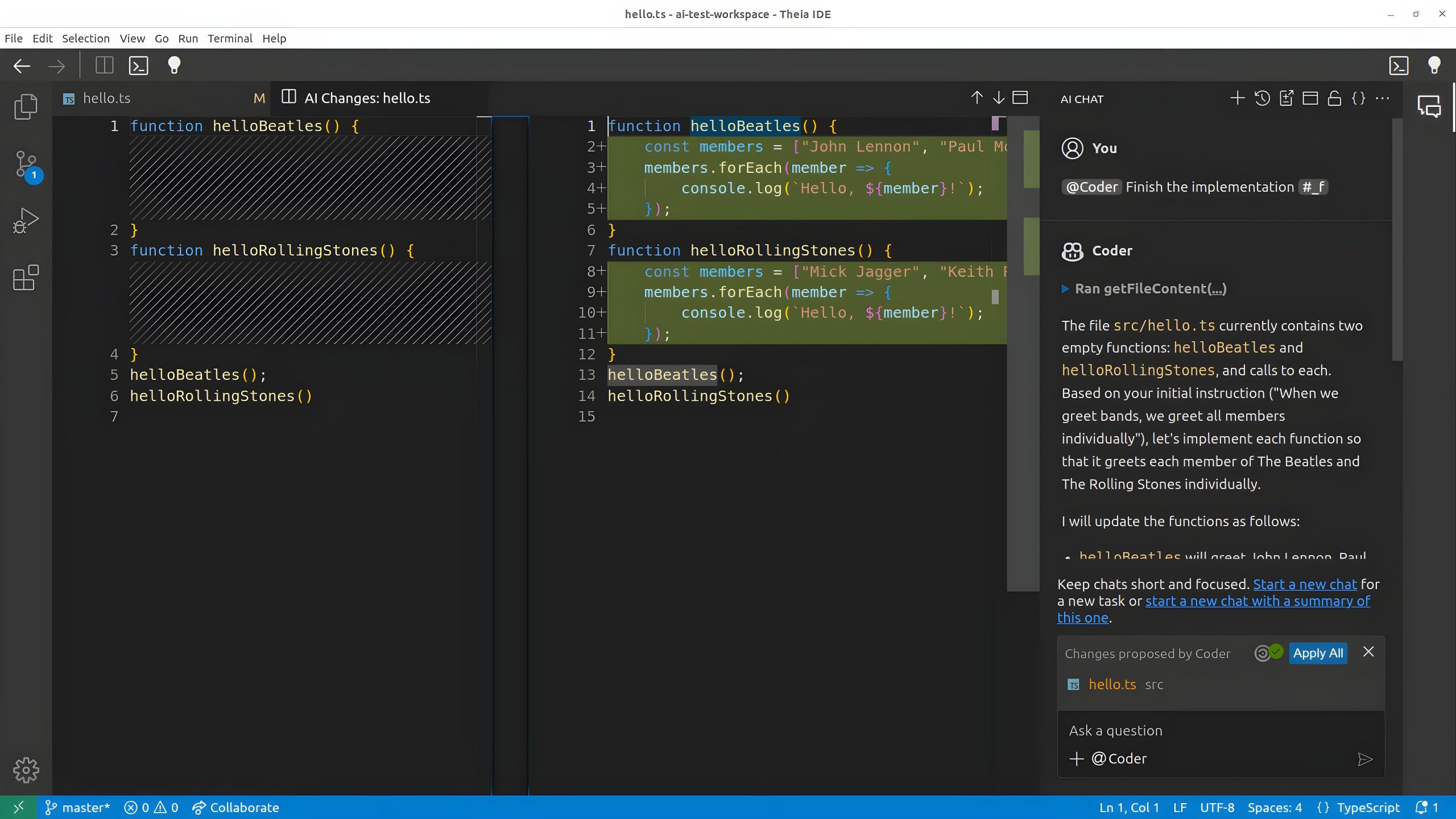

Di conseguenza, le piattaforme aperte si muovono più velocemente, Il panorama dell’AI si evolve rapidamente, con nuovi modelli che arrivano quasi ogni giorno. Mentre i fornitori commerciali spesso ritardano l’adozione per motivi di business, i progetti aperti come Theia AI integrano nuovi modelli come o1, DeepSeek o Gemini Pro nel giro di pochi giorni. Theia AI ha mostrato anche come fornire trasparenza e controllo consentendo la piena visibilità e modificabilità dei prompt e integrando il Model Context Protocol molto prima dei concorrenti commerciali.

Ma, soprattutto, le piattaforme aperte favoriscono un’innovazione ad ampio spettro che va ben oltre la selezione dei modelli. Le comunità possono esplorare in modo collaborativo strategie di prompting avanzate, sperimentare tecniche di recupero del contesto e perfezionare i modelli utilizzando set di dati condivisi per settori specifici. Questi sforzi producono informazioni preziose che vengono condivise apertamente, consentendo ad altri di imparare e costruire su di esse. Nell’AI, dove rapidità di iterazione, sperimentazione creativa e nuove combinazioni di idee sono fondamentali, l’open-source mostra la sua forza più grande: il potere della community. Questo è possibile perché le comunità aperte non sono vincolate da rigidi modelli di business o lunghe pipeline di integrazione. Le loro priorità sono utilità, sperimentazione e velocità, invece dell’allineamento ai flussi di ricavi di un unico attore.

Consentendo agli sviluppatori di costruire su e con l’AI, invece di consumarla semplicemente, aiutiamo a garantire che il futuro del software resti brillante, diversificato e guidato dalla comunità.

In prospettiva: rivendicare il ruolo dello sviluppatore

La buona notizia è che la community open-source sta già lavorando per risolvere queste problematiche. Non solo abbiamo LLM open-source di prima classe, ma il panorama degli strumenti sta vivendo una fase di innovazione. Come ecosistema tradizionalmente focalizzato sui tool, Eclipse Foundation ha recentemente rilasciato due progetti chiave in questo ambito:

- Theia AI (release pubblica) – un framework aperto che consente ai costruttori di tool di integrare direttamente i modelli linguistici di grandi dimensioni (LLM) di loro scelta in tool e IDE personalizzati, realizzando flussi di lavoro agenziali, suggerimenti AI contestualizzati e assistenza intelligente ritagliata su misura per le loro esigenze specifiche.

- AI-Powered Theia IDE (realese alpha) – Un ambiente di sviluppo software open-source basato sul framework Theia AI, che fornisce funzionalità AI avanzate progettate per aumentare la produttività degli sviluppatori con pieno controllo.

La stessa dinamica si registra in altri ecosistemi aperti, come il vivace mercato delle estensioni di codice VS. Trattandosi di strumenti aperti, le innovazioni si diffondono rapidamente e portano beneficio a tutta la community.

Questi approcci aperti agli strumenti AI hanno solitamente molte caratteristiche in comune:

- Flessibilità dei modelli: possibilità di scegliere quali modelli AI utilizzare, inclusi modelli locali che non richiedono l’invio di dati a servizi esterni.

- Trasparenza dei prompt: piena visibilità sul modo in cui il sistema istruisce i modelli AI, con la possibilità di modificare le istruzioni per esigenze specifiche.

- Controllo del contesto: meccanismi espliciti per controllare quale codice e contesto vengono condivisi con i sistemi AI.

- Estensibilità e adattabilità: sviluppatori e organizzazioni possono personalizzare ed espandere le funzionalità AI per soddisfare requisiti specifici.

Il successo di questi approcci open-source non è tuttavia scontato né garantito. Potremmo sperare che la storia si ripeta e che gli approcci aperti vincano nuovamente, come spesso hanno fatto. Ma l’AI non è solo un’evoluzione: è un vero cambio di paradigma che non può essere arrestato. Mai come oggi è forte la tentazione di accettare una scatola nera saldamente innestata nei propri processi di progettazione e ignorare le conseguenze a lungo termine per l’ecosistema di sviluppo, lasciando la produttività e la competitività future nelle mani di altri.

Il nostro messaggio a sviluppatori, aziende e costruttori di tool è chiaro: non barattate la vostra indipendenza a lungo termine con una convenienza a breve termine. Investite in strumenti che potete ispezionare, personalizzare e controllare per ottenere guadagni di produttività sostenibili nei vostri flussi di lavoro specifici alle vostre condizioni. Contribuite a creare ecosistemi che potenziano invece di intrappolare. La comunità open-source è impegnata a darvi una piattaforma completamente aperta, trasparente e affidabile per farvi diventare non solo un consumatore dipendente, ma un fautore dell’innovazione AI nativa. È questo il momento di sponsorizzare, investire e impegnarsi. Aprite la scatola nera e contribuite a creare un futuro nel quali l’AI lavori completamente alle vostre condizioni.

Il futuro sarà aperto?

L’AI sta trasformando il modo in cui costruiamo software. La domanda vera è: chi controlla questa trasformazione? Gli sviluppatori continueranno ad essere creatori attivi o diventeranno utilizzatori passivi di sistemi opachi controllati dai fornitori?

Siamo giunti a una svolta. Il fascino della comodità e dei rapidi guadagni esercitato dalle piattaforme proprietarie è forte, ma il prezzo da pagare è la dipendenza a lungo termine e un minore controllo. Gli strumenti AI aperti offrono un percorso diverso, radicato nella trasparenza, nell’adattabilità e nell’innovazione guidata dalla comunità.

La nostra scelta determinerà se la prossima generazione di tool per sviluppatori servirà gli interessi di pochi o il potenziale di molti. Per costruire un futuro che sia sicuro, flessibile e veramente incentrato sugli sviluppatori, dobbiamo mantenere i nostri strumenti aperti e la nostra agentività intatta.

L’AI dovrebbe amplificare la nostra creatività, non compromettere la nostra autonomia. Il futuro deve essere aperto.

Mike Milinkovich, Executive Director di Eclipse Foundation

Mike Milinkovich è una figura di spicco riconosciuta nel settore e un rappresentante della community open-source. Lavora nel mondo del software da oltre trent’anni occupandosi di tutto, dalla progettazione di software, alla gestione di prodotto, alle licenze IP. È dal 2004, un ruolo nel quale è responsabile del supporto alla community open-source di Eclipse e al suo ecosistema commerciale. Prima di entrare in Eclipse, Mike è stato vicepresidente nel gruppo di sviluppo di Oracle. Altre tappe della sua carriera sono state numerose startup, IBM e Nortel Research.

Come dirigente del settore, Mike ha avuto un posto nei Consigli Direttivi della Open Source Initiative (OSI) e della community OpenJDK, oltre a sedere nell’Executive Committee del Java Community Process (JCP).