Come afferma la società di cybersecurity NordVPN, dalle voci deepfake al phishing tramite falsi siti di colossi tech, l’AI trasforma le minacce online, esponendo gli utenti a nuovi pericoli.

All’inizio di quest’anno, sottolinea NordVPN, un imprenditore italiano ha ricevuto una telefonata che sembrava provenire dal ministro della Difesa Guido Crosetto. La voce era impeccabile, convincente, urgente e familiare. Chi chiamava sosteneva che alcuni giornalisti fossero stati rapiti in Medio Oriente e che fosse necessario pagare un riscatto.

Milioni di euro sono stati quasi persi in una truffa che sfruttava l’AI per clonare la voce del ministro. Le forze dell’ordine sono intervenute rapidamente per bloccare i fondi, ma il danno era già stato fatto: la fiducia era stata manipolata da una macchina.

“Questo incidente non è un caso isolato. Segnala una tendenza più ampia e preoccupante: oggi l’intelligenza artificiale non è più solo uno strumento in grado di innovare, è un’arma pericolosa nelle mani dei criminali informatici”, afferma Marijus Briedis, chief technology officer (CTO) di NordVPN.

Il Cyber Security Report 2025 conferma una percezione crescente tra gli italiani: il confine tra inganno digitale e realtà si fa sempre più labile. Le frodi basate sull’intelligenza artificiale aumentano in frequenza, sofisticazione e personalizzazione. Pur restando prevalenti phishing e malware, la natura delle minacce si sta trasformando, con un’attenzione crescente ai consumatori come principali bersagli.

Le campagne di phishing sono ora potenziate dall’intelligenza artificiale generativa per creare email, siti web e persino messaggi vocali o video falsi ma convincenti. L’aumento dei contenuti deepfake è particolarmente allarmante, poiché consente agli aggressori di impersonare individui o marchi affidabili con un realismo senza precedenti.

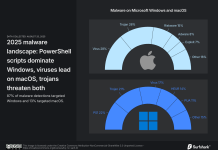

Questa minaccia va oltre i dirigenti di alto profilo. Ogni utente internet italiano è a rischio. Secondo uno studio di NordVPN, molte truffe si presentano come servizi legittimi, ad esempio il supporto tecnico di Microsoft o gli avvisi di accesso di Google, ma indirizzano gli utenti verso siti contraffatti progettati per la sottrazione delle credenziali. Lo studio evidenzia inoltre migliaia di siti fraudolenti su piattaforme di streaming e hosting, ormai vettori privilegiati per la diffusione di malware e per i furti d’identità.

Un ostacolo significativo alla difesa è la mancanza di consapevolezza da parte del pubblico. Un altro studio di NordVPN ha rilevato che oltre la metà degli italiani non è sicura di come funzioni l’intelligenza artificiale e il 64% non si rende conto che l’AI può generare voci o contenuti falsi. Questa lacuna di conoscenza è un fattore chiave che favorisce le truffe basate sull’intelligenza artificiale.

“Le frodi basate sull’intelligenza artificiale non sono più solo teoriche”, afferma Briedis. “Ciò che rende pericolose queste truffe è la loro credibilità. Quando qualcuno sente una voce di cui si fida o vede un messaggio proveniente da una fonte conosciuta, agisce d’istinto. È proprio su questo che contano i truffatori“.

Secondo gli esperti, la clonazione vocale basata sull’AI è avanzata rapidamente grazie al deep learning e alla facile disponibilità di campioni audio sui social. Strumenti economici consentono ai truffatori di generare voci false molto credibili, anche nei registri emotivi, rendendo le frodi più difficili da riconoscere e più facili da diffondere.

Poiché l’AI aumenta la verosimiglianza degli schemi fraudolenti, è necessario che gli utenti adottino comportamenti digitali più prudenti. Briedis invita a verificare l’attendibilità della fonte prima di rispondere a qualunque comunicazione inattesa, soprattutto se sollecita informazioni personali o trasferimenti di denaro.

Sono indispensabili anche un quadro normativo più stringente e controlli più efficaci sulla privacy nei social media: le piattaforme dovrebbero limitare l’accesso ai contenuti audio, implementare sistemi di rilevazione della clonazione vocale e promuovere l’educazione degli utenti per ridurre l’uso improprio dei dati vocali.

“Le truffe non sono più soltanto tecniche, ma anche psicologiche”, sottolinea Briedis. “L’AI sta alzando la posta in gioco e la consapevolezza è ora la vostra prima linea di difesa”.