Ciao a tutti! Sono Vincenzo Lomonaco, ricercatore all’Università di Pisa, e per la puntata di oggi commenteremo insieme tre importanti novità della scorsa settimana che hanno concentrato l’attenzione dell’intera comunità dell’intero mondo dell’intelligenza artificiale: la GPU Technology Conference organizzata da Nvidia, il lancio della piattaforma Nvidia Blackwell e le recenti novità, speculazioni direi, rispetto al lancio di GPT-5 di OpenAI.

Durante la conferenza GTC, ormai un evento centrale nel mondo AI dal 2009, Jensen Huang, l’amministratore delegato di Nvidia, ha presentato la nuova piattaforma di calcolo Blackwell, progettata per rivoluzionare o meglio supportare l’intelligenza artificiale generativa.

Blackwell promette un avanzamento significativo in termini di potenza di calcolo, ma anche di sostenibilità energetica rispetto alla scala alla quale si opera in questi casi.

Ma prima di approfondire questo nuovo prodotto Nvidia, concentriamoci sui punti salienti della conferenza, che ha segnato il ritorno dell’evento fisico dopo cinque anni, con oltre 11.000 partecipanti in presenza in California e decine di migliaia online, quindi anche un numero piuttosto significativo per le conferenze del mondo dell’intelligenza artificiale, e ospitato oltre 900 sessioni, tra cui una discussione aperta, un panel con diversi pionieri del mondo scientifico e tecnologico.

Infine, vale la pena sottolineare anche l’introduzione alla conferenza con L’arte dell’AI di Refik Anadol, davvero molto pionieristico, che dimostra in qualche modo anche l’impatto visivo dell’intelligenza artificiale.

Oltre a Blackwell, Huang ha introdotto due importanti novità nel mondo di Nvidia, i microservizi NIM (Nvidia Inference Manager) e API Cloud Omniverse.

Entrambi offrono strumenti per lo sviluppo più agevole di applicazioni, tra infrastrutture di calcolo remoto e quindi per il training, l’addestramento di modelli funzionali e generativi e la computazione che può avvenire tramite processi ottimizzati di inferenza predizione direttamente sui dispositivi integrati.

Alla conclusione del suo intervento, Huang ha delineato anche una visione per il futuro, in cui i data center, che Nvidia alimenta principalmente con le sue soluzioni hardware, saranno visti come fabbriche di AI, quindi generando intelligenza come prodotto.

Una visione particolarmente suggestiva e con l’adozione di Blackwell da parte di diversi leader del settore, come hanno già dichiarato con un comunicato stampa congiunto.

Nvidia si posiziona sempre di più come pioniera nell’era dell’AI generativa.

Tornando a Blackwell, sappiamo che le GPU o unità di elaborazione grafica hanno avuto un’evoluzione significativa dalla loro introduzione.

Originariamente nei primi PC, inizialmente erano chip grafici utilizzati per migliorare la visualizzazione del testo o l’elaborazione di immagini sui monitor per renderla più veloce, principalmente.

Con il passare del tempo, le GPU sono diventate più potenti e complesse e capaci di gestire rendering grafici 2D e 3D e di supportare l’elaborazione parallela dei dati, spesso per il calcolo scientifico.

L’impatto delle GPU sul mondo dell’intelligenza artificiale è stato trasformativo, ma solo molto tardi rispetto ai suoi primi sviluppi.

Grazie alla loro capacità di eseguire calcoli paralleli, le GPU si sono rivelate ideali principalmente per supportare l’addestramento di modelli basati su deep learning, su apprendimento automatico profondo, che richiedono l’elaborazione di grandi quantità di dati, utilizzando peraltro metodologie e computazioni legati all’algebra lineare.

Questo è avvenuto dagli anni 2000 in poi e ha permesso un avanzamento significativo nel campo dell’AI, con applicazioni che vanno dal riconoscimento di immagini, del parlato, alla guida autonoma, alla ricerca medica.

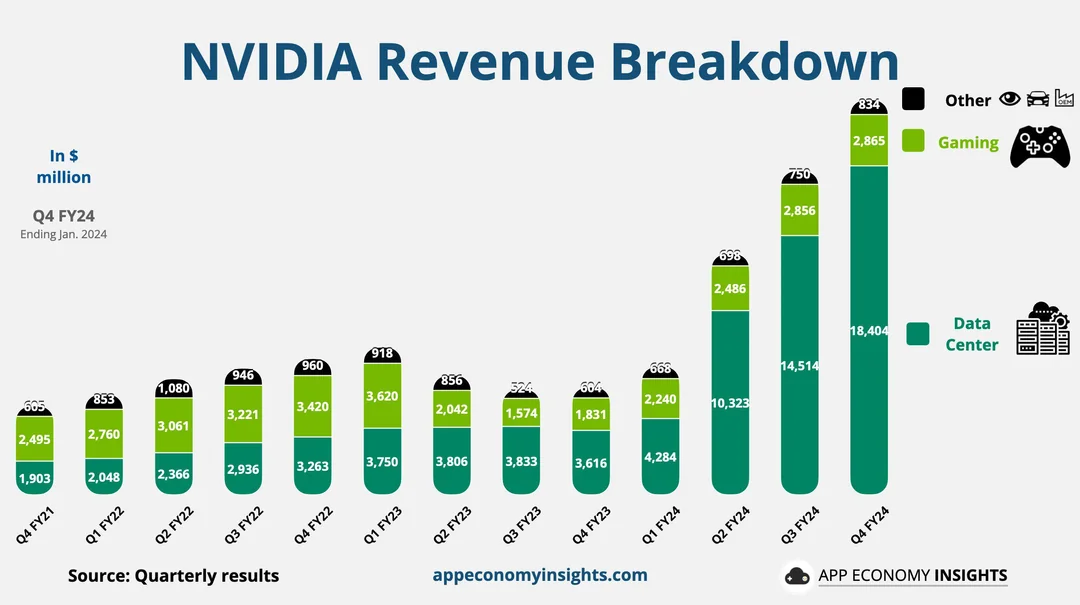

Ecco, è interessante notare come vediamo in questa figura, analizzando gli introiti dell’azienda Nvidia per settore a partire dal 2021, come il supporto computazionale offerto ai data center, calcolo scientifico, AI, ecc. abbia pareggiato nel primo quadrimestre del 2023 e di gran lunga superato successivamente il guadagno relativo a quello offerto all’industria dei videogiochi, che è sempre stato un settore di riferimento per Nvidia, cambiando a tutti gli effetti il modello di business dell’azienda, adesso tutta volta, come vedete anche dalle sue operazioni di marketing, al mondo dell’intelligenza artificiale.

Quindi Blackwell rappresenta, se vogliamo, l’ultimissima evoluzione di questo trend tecnologico offerto da Nvidia, progettata specificatamente in questo caso per supportare l’AI generativa.

Con 208 miliardi di transistor Blackwell introduce un nuovo livello di potenza computazionale in un formato rack, quindi si va verso un sistema e una piattaforma computazionale davvero importante e basata su quello che viene chiamato un Transformer Engine di seconda generazione che accelera l’inferenza e l’addestramento di modelli specifici di grandi dimensioni chiamati Transformer e al tempo stesso velocizza anche la commistione di diversi di questi modelli che operano, come viene chiamata commistione di esperti, in termini tecnici.

Questo grazie anche a tecnologie particolarmente avanzate come il micro-tensor scaling e nuovi livelli di precisione raggiunti per i Tensor Cores.

Uno dei principali vantaggi di Blackwell per l’AI è la sua capacità di supportare modelli davvero molto grandi, con trilioni di parametri da prendere, offrendo prestazioni senza precedenti e riducendo anche significativamente i costi.

Questo è un po’ quello che è stato promesso.

La piattaforma è stata adottata già da diversi fornitori, come accennavamo, e inoltre aggiunge ulteriori elementi a suo contorno, per esempio includendo quello che viene chiamato l’Nvidia Confidence Computing, che protegge i dati sensibili e i modelli da accessi non autorizzati direttamente, garantendo delle misure in più a livello hardware.

Inoltre, tra gli elementi tecnici da considerare vi è anche l’introduzione della 5ª generazione di NVLink Switch, che permettono una comunicazione particolarmente veloce e fluida tra le GPU montate all’interno di Blackwell, per lavorare su scala Exascale per modelli con trilioni di parametri, come dicevamo.

Si ipotizza che Blackwell B200, uno dei modelli principali, avrà un costo compreso tra 30.000 e 40.000 dollari.

Dalla scorsa settimana abbiamo anche qualche speculazione sull’attesissimo GPT-5.

GPT-5 è l’ultima innovazione nel campo dell’intelligenza artificiale sviluppata da OpenAI e atteso con grande interesse dalla comunità tecnologica, ingegneristica e applicativa del mondo reale.

Questo modello rappresenta semplicemente il successore – si ipotizza, sempre – di GPT-4 che stiamo utilizzando anche tramite ChatGPT e si prevede che porterà notevoli miglioramenti nel trattamento del linguaggio naturale, eliminando delle allucinazioni e offrendo ulteriori vantaggi a tutte le applicazioni downstream guidate dall’AI.

Le aspettative su GPT-5 sono alimentate principalmente dalla nostra immaginazione e dalle speculazioni che circolano in rete all’interno della comunità tecnologica.

Si prevede che GPT-5 possa avere una multimodalità completa, cioè possa elaborare in maniera sinergica testo, audio, immagini, video e dati di profondità, per esempio, e questa caratteristica potrebbe rivoluzionare significativamente il modo in cui interagiamo con le macchine.

Pensate anche quanto è risultata vantaggiosa la semplice combinazione di testo e immagini, per esempio per descrivere il contenuto di un’immagine o interrogare il sistema sulla natura dell’immagine stessa della scena che stiamo analizzando.

La data di uscita di GPT-5, è prevista per il 2024 da alcune fonti. Business Insider, per esempio, indica la possibilità dell’uscita di questo nuovo modello della serie nel corso dell’estate.

Tuttavia, è importante sottolineare come tutte le informazioni che riguardano GT5 sono basate solo su previsioni. Possono essere soggetti a cambiamenti, soprattutto considerando gli eventi trasformativi che ha vissuto la stessa azienda di riferimento, OpenAI, e la velocità con la quale maturano e si cambiano determinate decisioni nel campo.

Quindi OpenAI non ha ancora rilasciato dettagli ufficiali e tutto quello che si legge in rete va gestito con una certa cautela.

Quindi, per concludere, da un lato abbiamo una rilanciata potenza di calcolo offerta da produttori come Nvidia con la sua recentissima piattaforma Blackwell, che sarà sul mercato si ipotizza entro la fine dell’anno, come promette Nvidia.

Dall’altro una possibilità significativa di migliorare i modelli multimodali del filone GPT.

Quindi, tutto sommato, cosa ci aspetta per il futuro? Sicuramente un anno ricco di ulteriori applicazioni concrete ingegnerizzate grazie a questa nuova tecnologia che sarà sempre più pervasiva in ogni contesto.