Google ha annunciato Gemini Robotics e Gemini Robotics-ER, i nuovi modelli di AI basati su Gemini 2.0 che abilitano una nuova generazione di robot più versatili, interattivi e precisi, sfruttando le capacità avanzate di Gemini.

Gemini Robotics è il modello di visione-linguaggio-azione di Google più avanzato e attinge alla comprensione multimodale del mondo di Gemini e aggiunge le azioni fisiche come nuova modalità di output.

Gemini Robotics-ER è un modello di visione-linguaggio con una comprensione spaziale avanzata, che consente a chi progetta robot di eseguire i propri programmi utilizzando le capacità di ragionamento di Gemini.

Google sta collaborando con Apptronik per far avanzare la prossima generazione di robot umanoidi. Inoltre, ha reso disponibile il modello Gemini Robotics-ER a una selezione di trusted tester, tra cui Agile Robots, Agility Robots, Boston Dynamics ed Enchanted Tools.

Per far progredire la ricerca sulla sicurezza della robotica in ambito accademico e industriale, Google rilascerà nuovi benchmark e framework per la sicurezza semantica nell’intelligenza artificiale e nella robotica. Il tutto – sottolinea Big G – all’insegna di un approccio olistico nella ricerca, capace di combinare la sicurezza fisica, dei contenuti e semantica.

Per far progredire la ricerca sulla sicurezza della robotica in ambito accademico e industriale, Google rilascerà nuovi benchmark e framework per la sicurezza semantica nell’intelligenza artificiale e nella robotica. Il tutto – sottolinea Big G – all’insegna di un approccio olistico nella ricerca, capace di combinare la sicurezza fisica, dei contenuti e semantica.

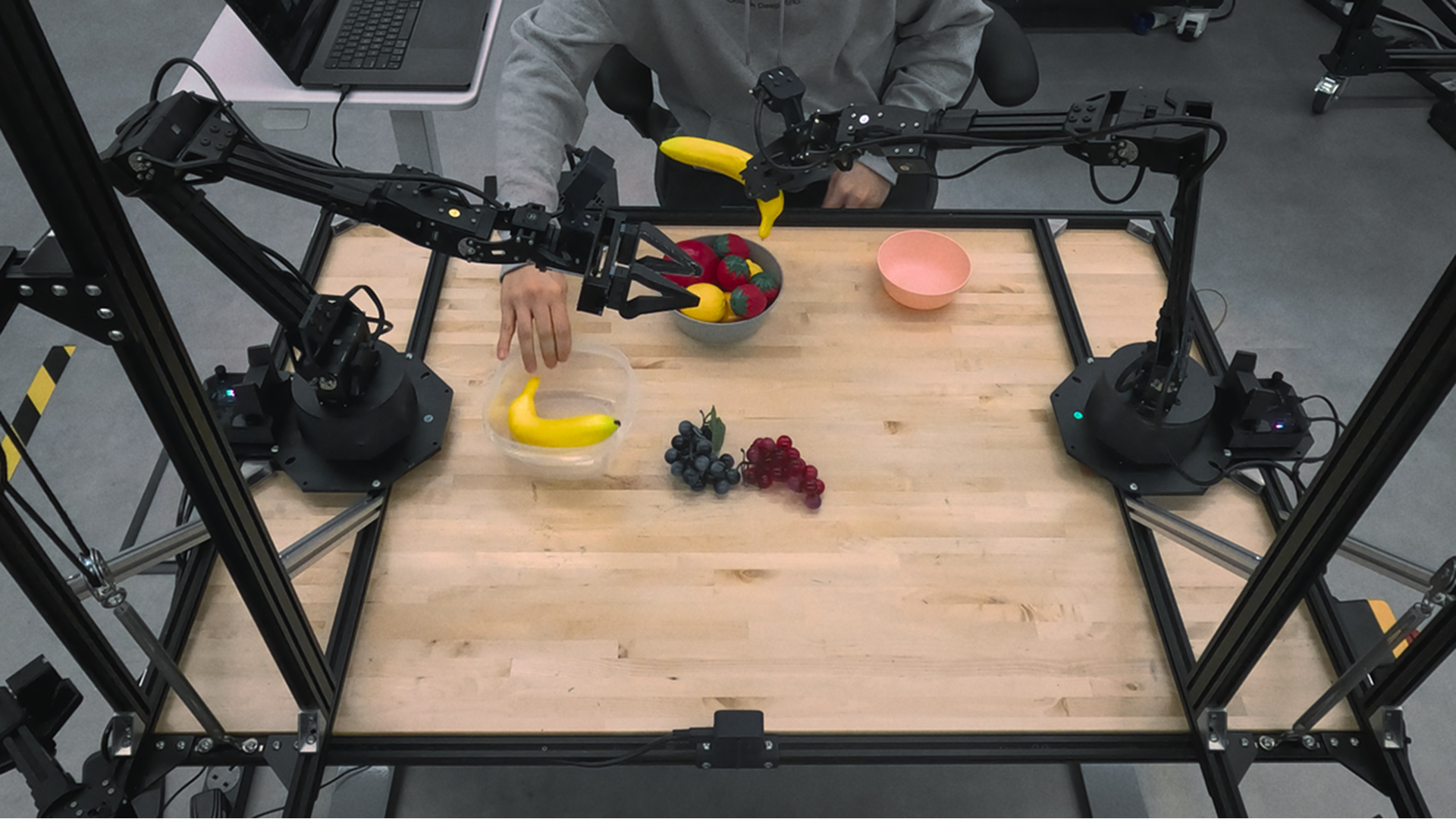

Gemini Robotics sfrutta la comprensione del mondo di Gemini per generalizzare a situazioni nuove e risolvere un’ampia varietà di compiti, compresi quelli che non ha mai visto prima durante l’addestramento. Gemini Robotics è anche in grado di gestire nuovi oggetti, istruzioni diverse e nuovi ambienti. Nel report tecnico, Google dimostra che, in media, Gemini Robotics ha più che raddoppiato le prestazioni su un benchmark di generalizzazione completo rispetto ad altri modelli di visione-linguaggio-azione all’avanguardia.

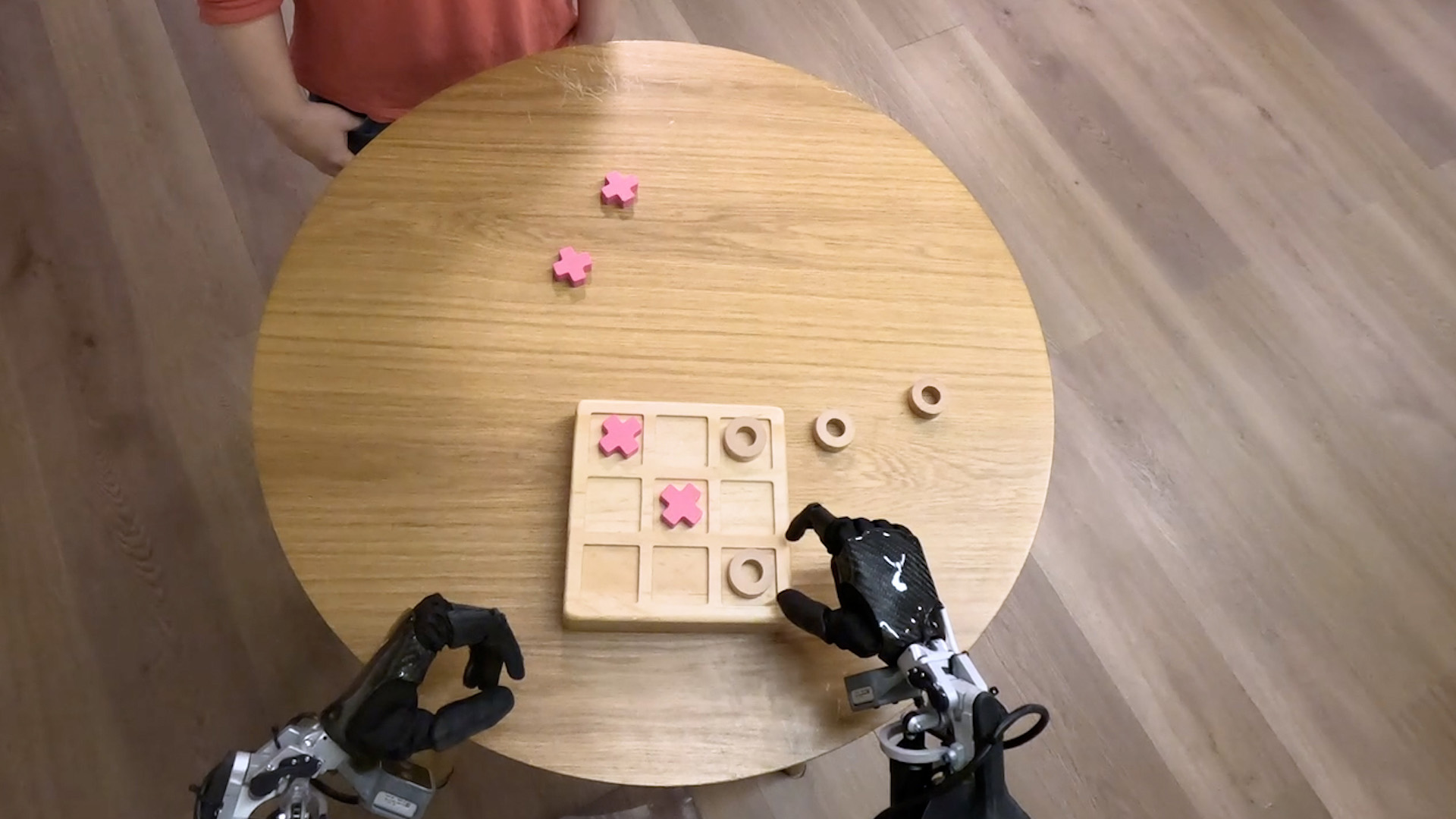

Essendo costruito sulla base di Gemini 2.0, Gemini Robotics è intuitivamente interattivo. Sfrutta le capacità avanzate di comprensione del linguaggio di Gemini e può comprendere e rispondere a comandi formulati nel linguaggio quotidiano e colloquiale e in lingue diverse.

Essendo costruito sulla base di Gemini 2.0, Gemini Robotics è intuitivamente interattivo. Sfrutta le capacità avanzate di comprensione del linguaggio di Gemini e può comprendere e rispondere a comandi formulati nel linguaggio quotidiano e colloquiale e in lingue diverse.

È in grado di comprendere e rispondere a una serie molto più ampia di istruzioni in linguaggio naturale rispetto ai modelli di Google precedenti, adattando il suo comportamento agli input. Inoltre, monitora continuamente l’ambiente circostante, rileva i cambiamenti dell’ambiente o delle istruzioni e regola le sue azioni di conseguenza. Questo tipo di controllo, o “governabilità”, può aiutare meglio le persone a collaborare con gli assistenti robotici in una serie di ambienti, dalla casa al posto di lavoro.

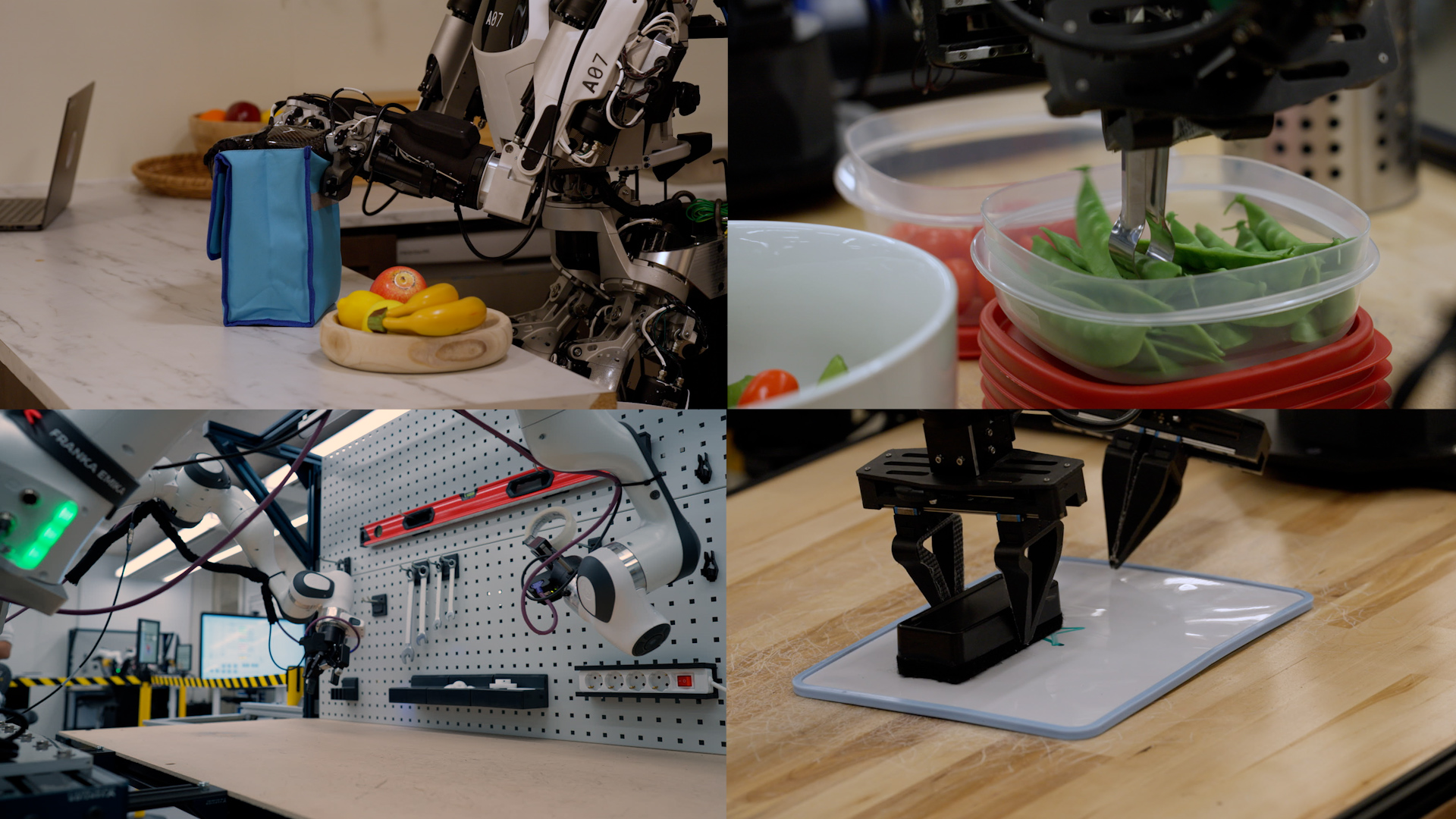

Oltre alla generalizzazione e all’interattività, il terzo pilastro fondamentale per costruire un robot utile è agire con destrezza. Molti compiti quotidiani che gli esseri umani svolgono senza sforzo richiedono abilità motorie sorprendentemente fini e sono ancora troppo difficili per i robot. Al contrario, Gemini Robotics è in grado di affrontare compiti estremamente complessi e in più fasi che richiedono una manipolazione precisa, come piegare un origami o impacchettare uno snack in un sacchetto per alimenti.

Oltre alla generalizzazione e all’interattività, il terzo pilastro fondamentale per costruire un robot utile è agire con destrezza. Molti compiti quotidiani che gli esseri umani svolgono senza sforzo richiedono abilità motorie sorprendentemente fini e sono ancora troppo difficili per i robot. Al contrario, Gemini Robotics è in grado di affrontare compiti estremamente complessi e in più fasi che richiedono una manipolazione precisa, come piegare un origami o impacchettare uno snack in un sacchetto per alimenti.

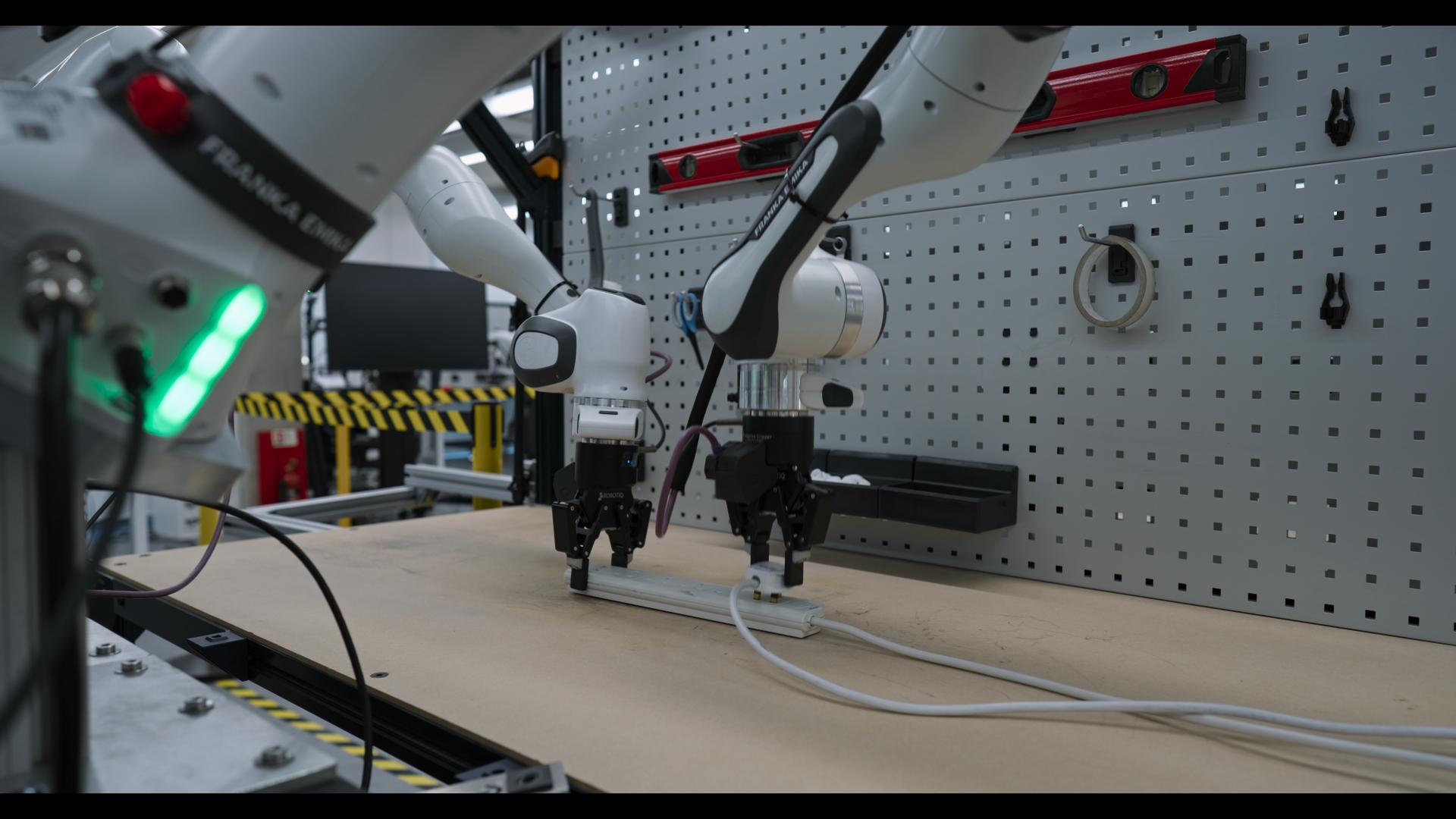

Infine, poiché i robot sono di tutte le forme e dimensioni, Gemini Robotics è stato progettato per adattarsi facilmente a diversi tipi di robot. Il team ha addestrato il modello principalmente sui dati della piattaforma robotica bi-braccio ALOHA 2, ma ha anche dimostrato che è in grado di controllare una piattaforma bi-braccio basata sui bracci Franka utilizzati in molti laboratori accademici. Gemini Robotics può anche essere specializzato per implementazioni più complesse, come il robot umanoide Apollo sviluppato da Apptronik, con l’obiettivo di completare compiti del mondo reale.

Il modello Gemini Robotics-ER (abbreviazione di “embodied reasoning”) migliora la comprensione del mondo da parte di Gemini nei modi necessari per la robotica, focalizzandosi in particolare sul ragionamento spaziale, e consente ai produttori di robot di collegarlo ai loro controller di basso livello esistenti.

Gemini Robotics-ER migliora di molto le capacità esistenti di Gemini 2.0, come il puntamento e il rilevamento 3D. Combinando il ragionamento spaziale e le capacità di coding di Gemini, Gemini Robotics-ER può istanziare al volo capacità completamente nuove. Ad esempio, quando gli viene mostrata una tazza di caffè, il modello è in grado di intuire una presa appropriata con due dita per prenderla dal manico e una traiettoria sicura per avvicinarla.

Gemini Robotics-ER migliora di molto le capacità esistenti di Gemini 2.0, come il puntamento e il rilevamento 3D. Combinando il ragionamento spaziale e le capacità di coding di Gemini, Gemini Robotics-ER può istanziare al volo capacità completamente nuove. Ad esempio, quando gli viene mostrata una tazza di caffè, il modello è in grado di intuire una presa appropriata con due dita per prenderla dal manico e una traiettoria sicura per avvicinarla.

Gemini Robotics-ER è in grado di eseguire tutti i passaggi necessari per controllare un robot, compresi la percezione, la stima dello stato, la comprensione dello spazio, la pianificazione e la generazione del codice. In un’impostazione end-to-end di questo tipo, il modello raggiunge un tasso di successo 2x-3x rispetto a Gemini 2.0. E quando la generazione di codice non è sufficiente, Gemini Robotics-ER può anche sfruttare la potenza dell’in-context learning, seguendo i modelli di una manciata di dimostrazioni umane per fornire una soluzione.

Maggiori informazioni, anche sull’approccio del team di Google alla sicurezza nell’AI e nella robotica, è possibile consultare il blog di Google DeepMind.