Cohere ha rilasciato Embed 4, il suo più recente modello di embedding multimodale all’avanguardia, che consente alle aziende di integrare funzionalità avanzate di ricerca e recupero all’interno delle applicazioni di intelligenza artificiale — un elemento ormai essenziale per le imprese che sviluppano assistenti o agenti capaci di comprendere il proprio contesto aziendale.

Embed 4 – spiega Cohere – offre ai clienti:

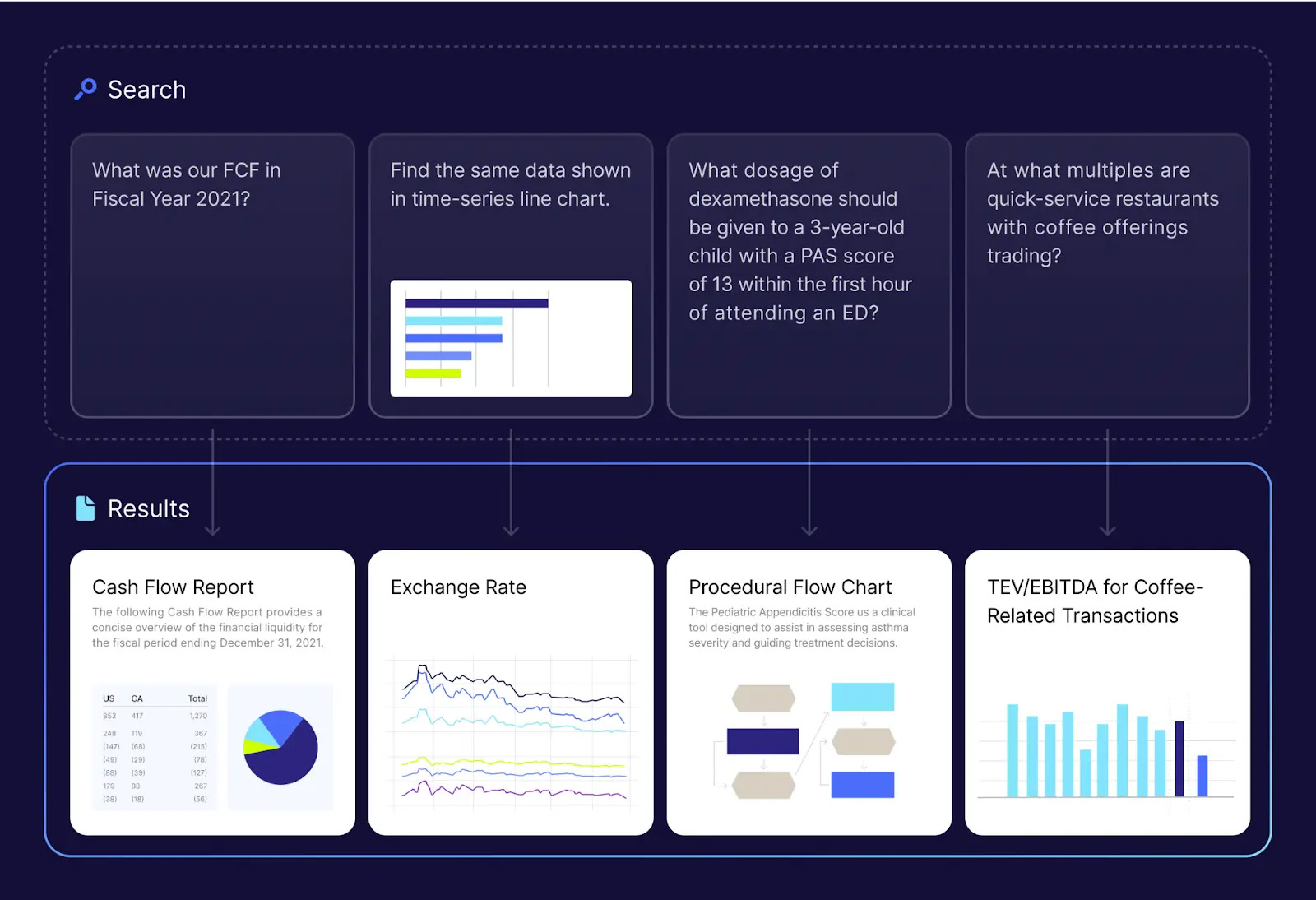

- Multimodalità allo stato dell’arte: Embed 4 è in grado di ricercare con precisione e rapidità documenti con molte sfaccettature, come ad esempio rapporti PDF complessi e slide di presentazioni dinamiche, sia che il documento sia basato sul testo sia che includa immagini, tabelle, grafici, codice e diagrammi.

- Lunghezza del contesto all’avanguardia: Embed 4 è in grado di generare embedding per documenti lunghi fino a 128K token (circa 200 pagine), come relazioni finanziarie annuali, manuali di prodotti o contratti legali dettagliati.

- Capacità multilingue avanzate: Embed 4 è multilingue in più di 100 lingue, comprese le principali lingue commerciali come l’arabo, il giapponese, il coreano e il francese, per supportare le aziende globali.

- Miglioramenti per i settori attenti alla sicurezza: Embed 4 è ottimizzato con una comprensione specifica dei dati di settori regolamentati come quello finanziario, sanitario e manifatturiero. Può essere distribuito in ambienti VPC (virtual private cloud) e on-premise per garantire la sicurezza dei dati.

I modelli di embedding esistenti – afferma Cohere – non riescono a comprendere in modo nativo i complessi materiali aziendali multimodali, portando le aziende a sviluppare complicate pipeline di pre-elaborazione dei dati che migliorano solo leggermente l’accuratezza. Embed 4 risolve questo problema, consentendo alle aziende e ai loro dipendenti di far emergere in modo efficiente le intuizioni nascoste in montagne di informazioni non ricercabili.

Embed 4 consente alle organizzazioni di effettuare ricerche sui documenti non strutturati, dove risiede la maggior parte dei dati importanti. È in grado di generare rappresentazioni di alta qualità di documenti complessi a modalità mista, il tutto in un vettore unificato. Questa capacità consente inoltre alle aziende di creare applicazioni in grado di comprendere le immagini di riferimento insieme alle domande di testo, consentendo agli utenti di utilizzare nuovi modelli di ricerca per accelerare la loro produttività.

Embed 4 consente alle organizzazioni di effettuare ricerche sui documenti non strutturati, dove risiede la maggior parte dei dati importanti. È in grado di generare rappresentazioni di alta qualità di documenti complessi a modalità mista, il tutto in un vettore unificato. Questa capacità consente inoltre alle aziende di creare applicazioni in grado di comprendere le immagini di riferimento insieme alle domande di testo, consentendo agli utenti di utilizzare nuovi modelli di ricerca per accelerare la loro produttività.

In particolare, Embed 4 eccelle nei settori regolamentati come quello finanziario, sanitario e manifatturiero. Oltre a una forte conoscenza generale del business, il modello è ottimizzato con una comprensione specifica del dominio di questi settori, in modo da poter identificare gli insight rilevanti all’interno dei documenti comuni.

Secondo Cohere, la lingua non dovrebbe mai essere un ostacolo all’accesso alle informazioni. Embed 4 offre una comprensione multilingue leader del settore in oltre 100 lingue come l’arabo, il francese, il giapponese e il coreano. Inoltre, è in grado di effettuare ricerche in tutte le lingue, assicurando che i dipendenti possano trovare i dati critici indipendentemente dalla lingua in cui sono archiviati o dalle lingue che parlano.

I dati aziendali tendono a essere imperfetti, mette in evidenza Cohere. Alcuni documenti presentano errori di ortografia, problemi di formattazione o pagine con orientamento orizzontale che dovrebbero essere in verticale. Per garantire che questi problemi non compromettano l’accuratezza dei risultati di ricerca, Embed 4 è stato addestrato per essere robusto nei confronti dei dati rumorosi del mondo reale. Inoltre, è in grado di effettuare ricerche su documenti scannerizzati e scrittura a mano. Questi formati sono comuni nei documenti legali, nelle fatture assicurative e nelle ricevute di spesa. Questa capacità elimina la necessità di una complessa preparazione dei dati o di pipeline di pre-elaborazione, facendo risparmiare alle aziende tempo e costi operativi.

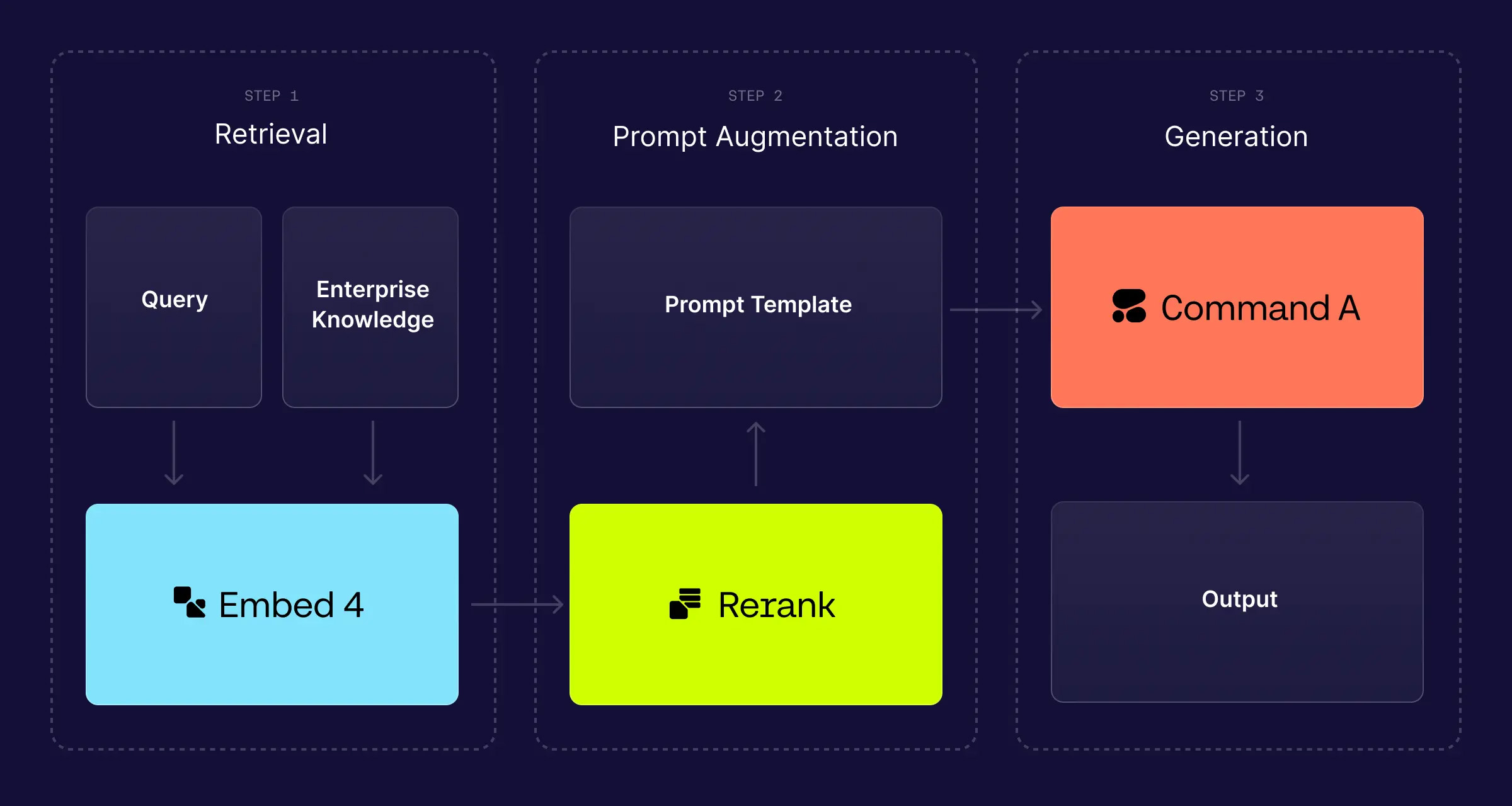

Per essere utili, i sistemi di intelligenza artificiale devono comprendere il contesto in cui operano. Gli assistenti AI impiegati nelle aziende svolgono questo compito attraverso un processo chiamato Retrieval-Augmented Generation (RAG). In sostanza, il modello AI generativa (ad esempio Command A) che alimenta l’esperienza di conversazione si affiderà a un motore di ricerca – collegato a informazioni aziendali proprietarie – per reperire informazioni pertinenti alle domande degli utenti prima di rispondere. In questo modo si migliora l’utilità delle risposte e si evitano le allucinazioni.

Embed 4 – afferma Cohere – è il motore di ricerca ottimale per gli assistenti e gli agenti AI aziendali. Oltre a una grande precisione in tutti i tipi di dati, il modello offre un’efficienza di livello enterprise. Questo gli consente di scalare per soddisfare le esigenze delle grandi organizzazioni. Inoltre, poiché gli elevati costi di archiviazione dei dati riducono il ROI degli investimenti tecnologici, il team di Cohere ha progettato Embed 4 per produrre embedding compressi. Ciò consente alle organizzazioni di risparmiare fino all’83% sui costi di archiviazione, pur mantenendo l’accuratezza della ricerca.

Embed 4 – afferma Cohere – è il motore di ricerca ottimale per gli assistenti e gli agenti AI aziendali. Oltre a una grande precisione in tutti i tipi di dati, il modello offre un’efficienza di livello enterprise. Questo gli consente di scalare per soddisfare le esigenze delle grandi organizzazioni. Inoltre, poiché gli elevati costi di archiviazione dei dati riducono il ROI degli investimenti tecnologici, il team di Cohere ha progettato Embed 4 per produrre embedding compressi. Ciò consente alle organizzazioni di risparmiare fino all’83% sui costi di archiviazione, pur mantenendo l’accuratezza della ricerca.

Le aziende possano utilizzare Embed 4 come base delle loro pipeline di ricerca e recupero, alimentando la prossima generazione di applicazioni AI in tutti i settori, afferma Cohere. Embed 4 si integra inoltre perfettamente con North, la piattaforma sicura di Cohere per agenti di intelligenza artificiale, alimentando le capacità di ricerca semantica del sistema di ricerca end-to-end presente in Compass. Lo stack tecnologico verticalmente integrato di Cohere consente alle aziende di integrare senza problemi i propri dati tra gli strumenti del luogo di lavoro, di costruire agenti di intelligenza artificiale personalizzati in base alle proprie esigenze e di mantenere il controllo sui propri dati dietro i firewall sicuri del proprio ambiente privato.

Embed 4 è disponibile anche su Amazon SageMaker e per la distribuzione privata in qualsiasi VPC o ambiente on-premise. Per saperne di più, è possibile ottenere ulteriori dettagli tecnici nella documentazione per sviluppatori.