Lo sviluppo di nuovi processori sempre più potenti procede senza sosta, da più parti però si sottolinea che i limiti allo sviluppo tecnologico degli approcci convenzionali si stanno facendo evidenti.

Passare a processi di microlitografia più precisi è possibile ma difficile e richiede un lasso di tempo crescente tra una generazione di CPU e la successiva con processi di produzione più raffinati. Non è (ancora) un problema per l’utente medio ma per chi considera il tema a lungo termine invece sì.

È il caso della Darpa, l’agenzia del Ministero della Difesa statunitense che porta avanti progetti di ricerca per l’uso militare ma le cui tecnologie sono state adottate in moltissime applicazioni civili. La Darpa ha avviato un progetto per lo sviluppo di approcci alternativi alla creazione di microprocessori. È un progetto ambizioso e a medio-lungo termine perché l’idea è quella di ripartire da zero abbandonando la visione classica che punta solo alla miniaturizzazione, scegliendo nuove strade in quanto a materiali, progettazione e architetture delle CPU.

Ad esempio, secondo la Darpa non c’è solo il silicio per realizzare processori ma “la tavola periodica è un ampio bacino di materiali possibili”, come anche non è obbligatorio progettare le CPU puntando sulla sola integrazione planare dei microcomponenti elettronici.

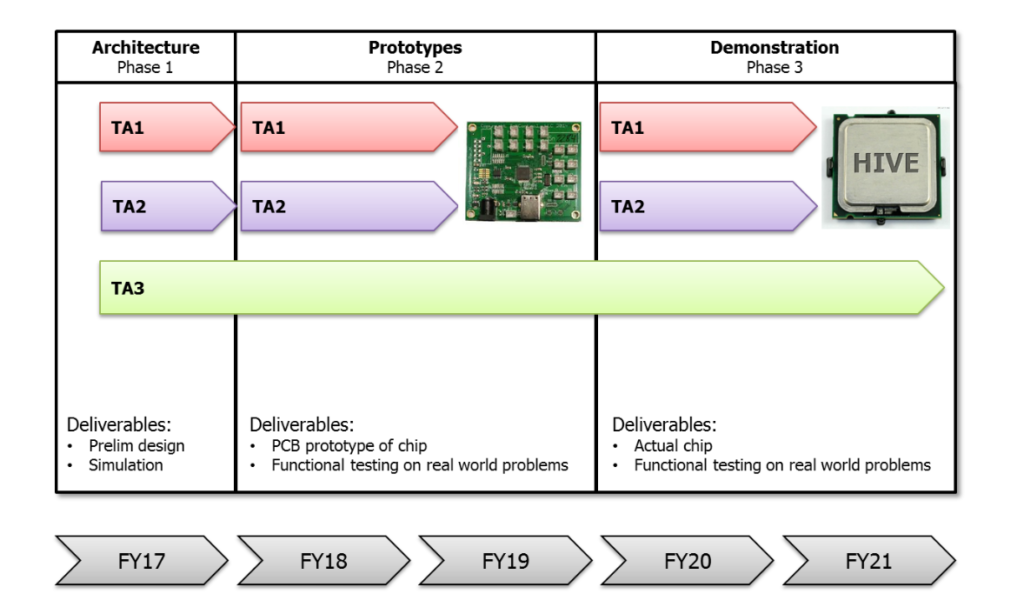

Un primo esempio della linea di sviluppo definita dalla Darpa è il processore Hive, che negli obiettivi dovrebbe essere concretizzato nel 2021. Si tratta di un graph analytics processor, studiato in modo specifico per analizzare grandi quantità di dati che assumono un significato solo quando si evidenziano le correlazioni fra loro.

Un primo esempio della linea di sviluppo definita dalla Darpa è il processore Hive, che negli obiettivi dovrebbe essere concretizzato nel 2021. Si tratta di un graph analytics processor, studiato in modo specifico per analizzare grandi quantità di dati che assumono un significato solo quando si evidenziano le correlazioni fra loro.

Il suo funzionamento logico è descritto direttamente dal nome: una sigla che sta per Hierarchical Identify Verify Exploit. Sono i quattro passi che secondo la Darpa vanno compiuti nell’analisi dei Big Data: ordinarli in una rappresentazione grafica a più livelli, identificare le relazioni, verificare che queste siano causali e non prive di significato, sfruttare alla fine il vero valore informativo dei dati stessi.

Dal punto di vista progettuale Hive richiede una visione innovativa del funzionamento dei processori e in generale dell’hardware di un sistema di analytics. Non è considerabile come un tradizionale processore di von Neumann perché per valutare le relazioni fra dati deve accedere ai dati stessi in memoria molto velocemente e indipendentemente da dove essi si trovano, con accesso anche contemporaneo per vari processi elaborativi. Si parla di bande di trasferimento di terabit al secondo. Le CPU tradizionali leggono invece i dati in maniera sequenziale e sono quindi troppo lente per gli scopi della Darpa.

Intel e Qualcomm sono state coinvolte dalla Darpa nel progetto di Hive, insieme ad altre realtà che si occuperanno di aspetti diversi. Le due aziende progetteranno ciascuna una architettura propria per Hive, alla fine della fase di sviluppo si deciderà quale strada seguire.

I segnali come vibrazioni

I progetti della Darpa non sono gli unici che puntano a rivisitare la progettazione dei processori. L’Università del Queensland, in Australia, e Lockheed Martin hanno avviato una collaborazione che mira a definire una nuova generazione di CPU dedicate alle applicazioni aerospaziali. Il punto critico di questo particolare uso dei processori è che nello spazio l’esposizione alle radiazioni elettromagnetiche è molto più intensa rispetto a quanto accade sulla Terra, il che influisce negativamente sulla conduzione dei segnali elettrici nei chip e lungo i circuiti.

Per risolvere questo problema il progetto prevede la creazione di chip in cui i segnali non vengono trasportati con elettricità ma attraverso vibrazioni. Questo dovrebbe essere reso possibile grazie all’uso di tecniche di nanofabbricazione che producano componenti grandi solo quanto qualche decina di atomi, da usare al posto dei microcomponenti elettronici tradizionali.